本次目标:部署 DeepSeek 本地模型,Chatbox 提供 UI 界面,并通过 Ollama 提供 API 支持。

原则:小白也能理解并真正的上手实践(操作简单)

1.下载Chatbox并配置为本地DeepSeek

2.下载Ollama并安装运行DeepSeek

3.不需要联网也能和DeepSeek畅快聊天

1.下载Chatbox并配置为本地DeepSeek

Chatbox官方网站:

https://chatboxai.app/en

我这里是Windows

下载的Chatbox-1.11.8-Setup.exe,大小100M多点,点击安装,按下面提示拖到Applications内:

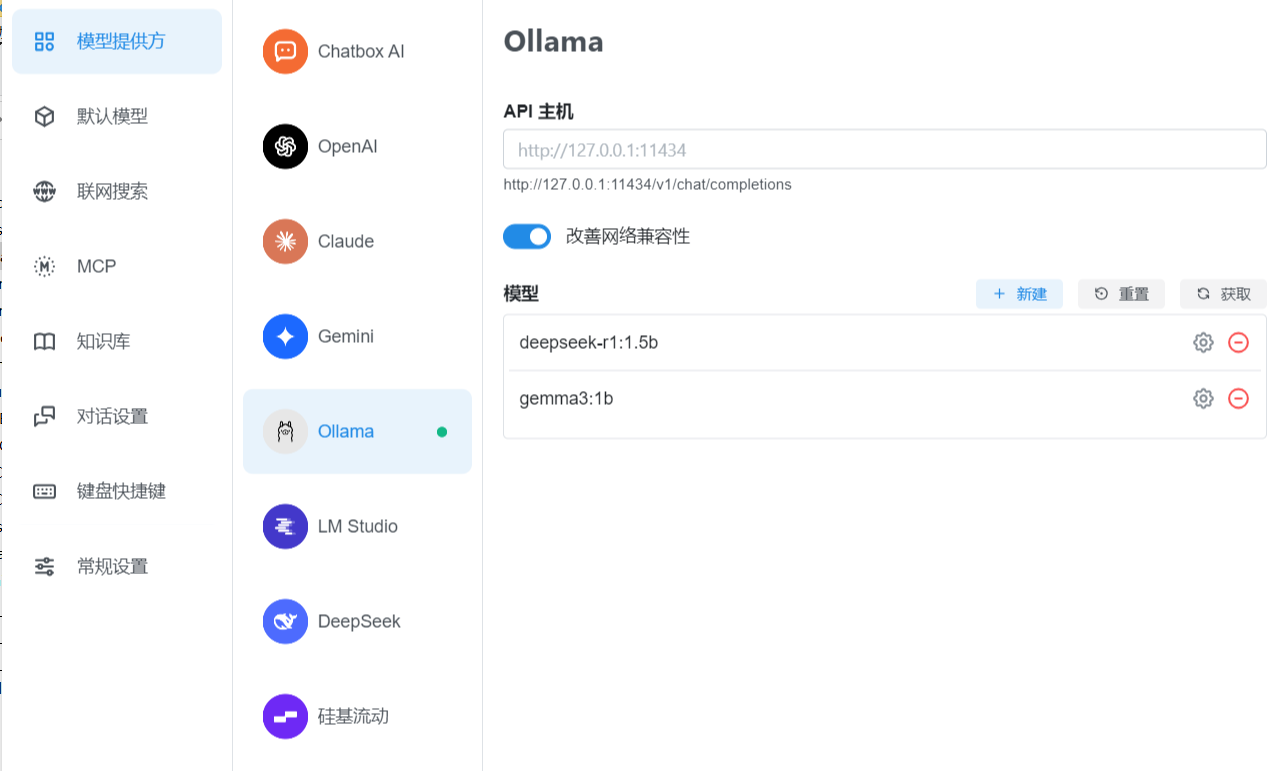

实际正确应该选择OLLAMA API,然后就可以看到我们上一步安装好的deepseek-r1:1.5b。

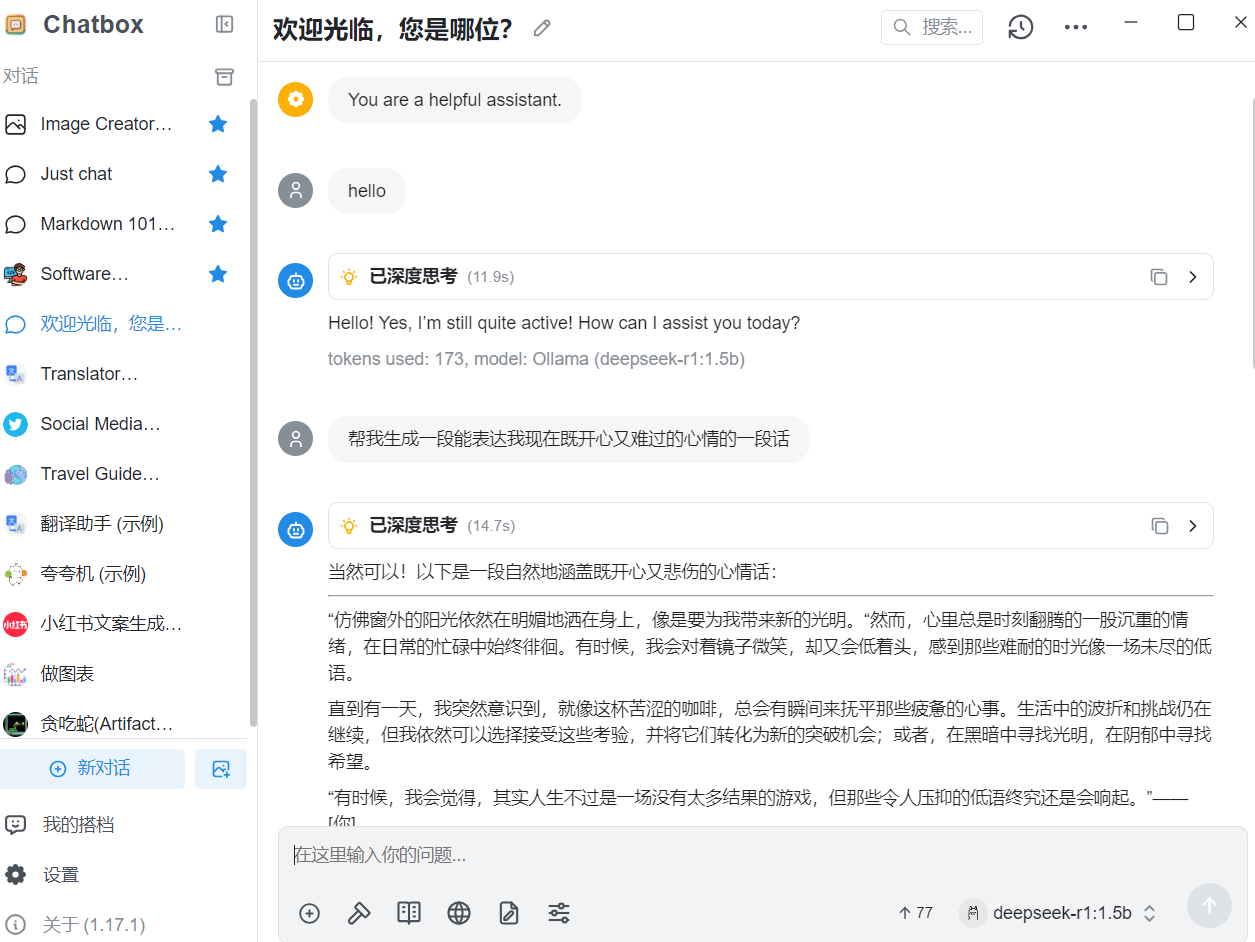

3.无需联网也能和DeepSeek畅快聊天

配置好DeepSeek本地模型之后,就可以实现在断网情况下自由问答了

2.下载Ollama并安装运行DeepSeek

从Ollama官方网站下载Ollama:

https://ollama.com/

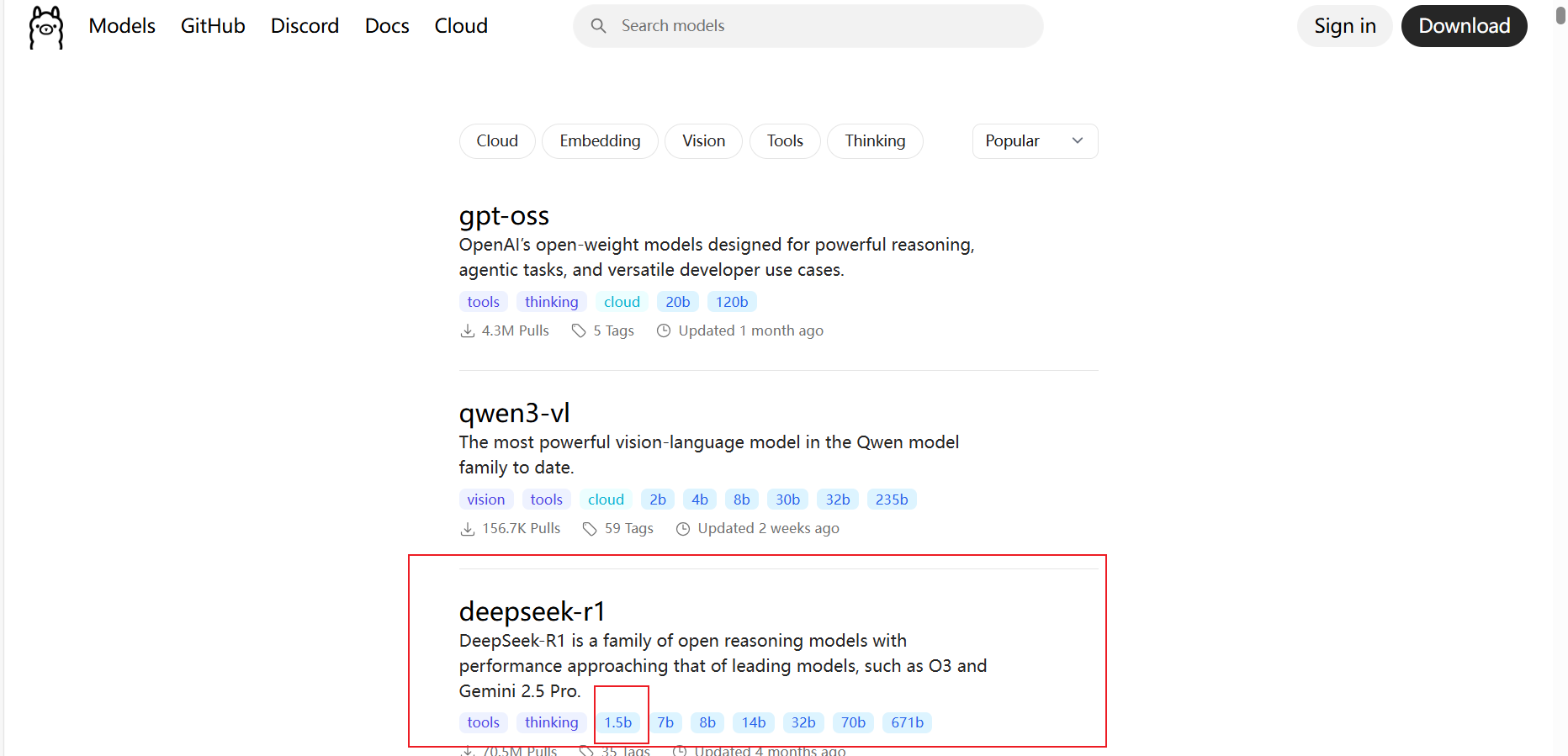

进入Ollama官方网站后,可以看到Ollama已经支持DeepSeek-R1的部署:

点击DeepSeek-R1的链接可以看到有关deepseek-r1的详细介绍:

目前deepseek-r1模型大小提供了7个选择:1.5b、7b、8b、14b、32b、70b、671b。

因为我笔记本的显卡配置较低,所以这里只能选择最小的1.5b模型来做演示:

你可以根据你的硬件情况选择,通常模型大小(参数量)越大,模型的理解和生成能力越强,但也会消耗更多的计算资源。

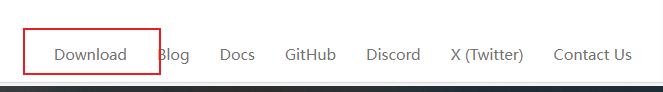

点击Download按钮下载符合自己平台的Ollama:

我这里选择windows,点击下载。

下载文件大小不到200M,文件名为:OllamaSetup.exe。

解压后打开Ollama应用程序,提示:

点击Install安装ollama。

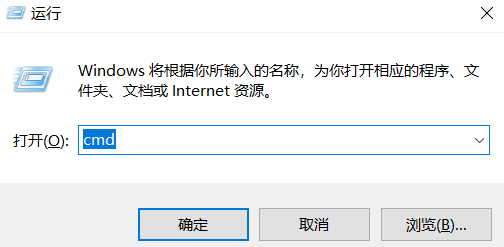

按照提示,打开终端,使用 Win + R 快捷键调用 terminal:

这里Ollama默认给出的例子是下载/运行llama3.2大模型,

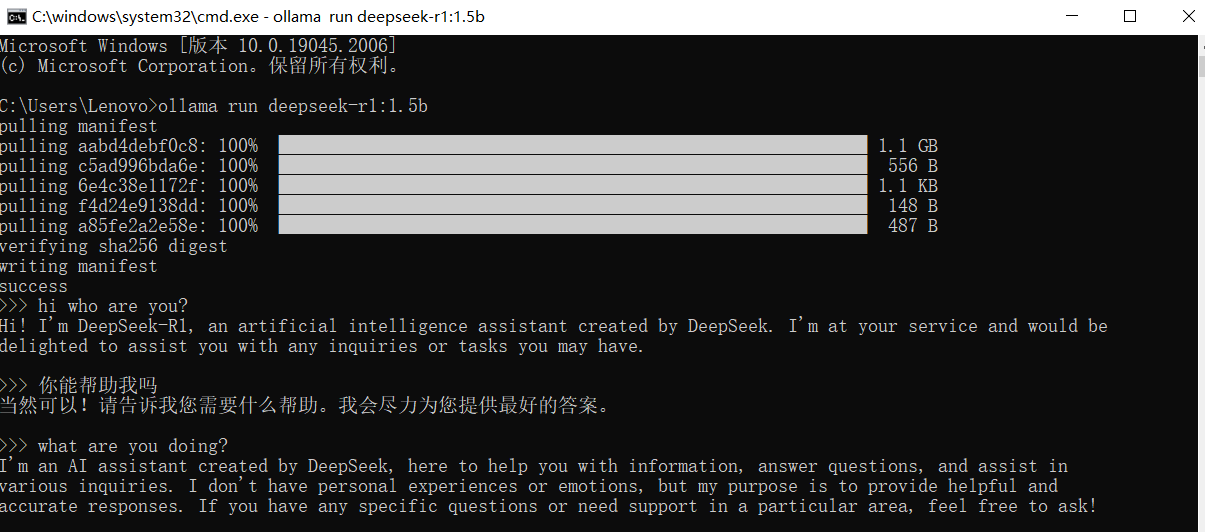

我们这里不使用这个llama3.2模型,直接下载/运行deepseek,参数选择最小的1.5b,在终端窗口运行下面命令:

ollama run deepseek-r1:1.5b

ollama run deepseek-r1:1.5b

pulling manifest

pulling manifest

pulling manifest

pulling manifest

pulling manifest

pulling manifest

pulling aabd4debf0c8... 100% ▕████████████████████████████████████████▏ 1.1 GB

pulling 369ca498f347... 100% ▕████████████████████████████████████████▏ 387 B

pulling 6e4c38e1172f... 100% ▕████████████████████████████████████████▏ 1.1 KB

pulling f4d24e9138dd... 100% ▕████████████████████████████████████████▏ 148 B

pulling a85fe2a2e58e... 100% ▕████████████████████████████████████████▏ 487 B

verifying sha256 digest

writing manifest

success

Send a message (/? for help)

这里就直接可以和DeepSeek对话了:

Hi! Who are you?

Hi! I'm DeepSeek-R1, an artificial intelligence assistant created by DeepSeek. I'm at your service

and would be delighted to assist you with any inquiries or tasks you may have.

Send a message (/? for help)