本地部署

-

本地部署一般是在自己的服务器上部署,但这里以本地电脑进行部署为例,由于电脑配置远远无法支持大模型配置要求,届时部署下来的也是阉割版的。

-

本地部署一种方案就是ollama,官方地址:https://ollama.com

-

访问后点击下载,我这里是Windows版本(Linux可以直接通过指令下载)

-

![image]()

-

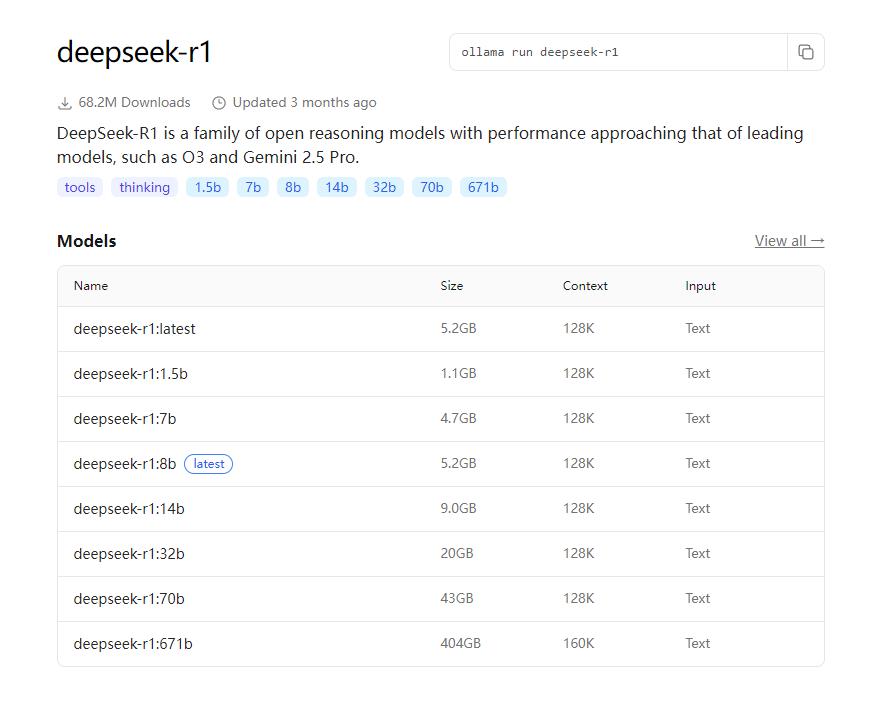

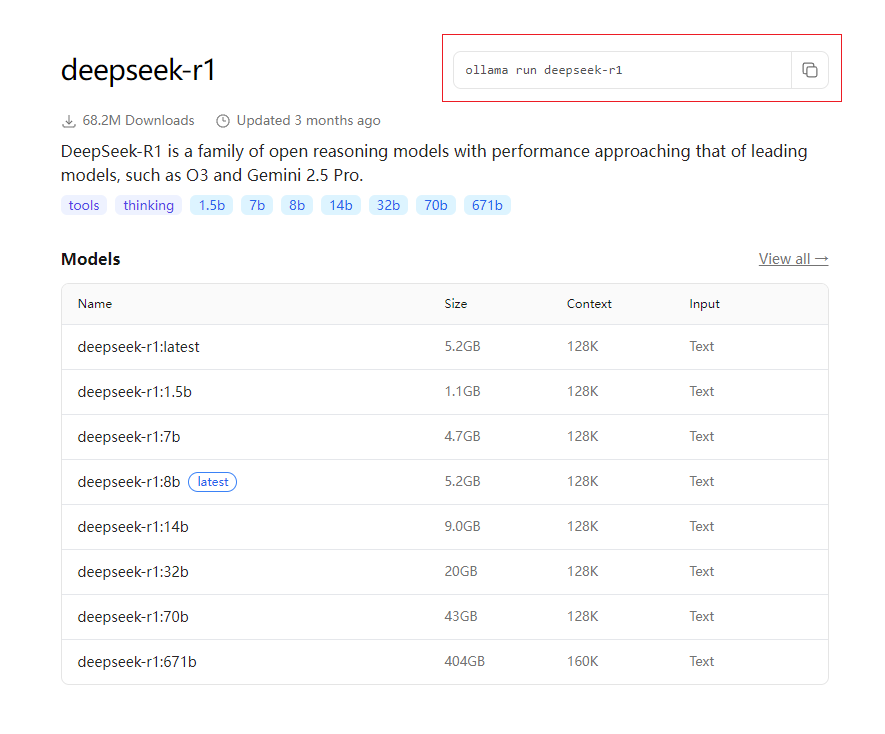

下载期间我们可以看一下ollama左上角的Models,可以看到各种模型,随便点击一个模型进入详情页,可以看到各种版本和大小,以及运行的指令,学过docker的同学一个很熟悉这些指令的语法,是的,跟docker类似。

- 这里的b是billion,10亿的意思,故1.5b就是15亿,表示模型支持的参数数量,可以通过参数对模型进行微调。参数越多,模型推力分析能力越强。所以671b就是deepseek的满血版。

- 我们的电脑部署得看显存,比如显存为6g,那1.5b,1.7b和1.8b都可以部署,以此类推。(通过ctrl+shift+esc打开任务管理器,点击性能,找到GPU 即可看到显存)

-

![image]()

-

![image]()

-

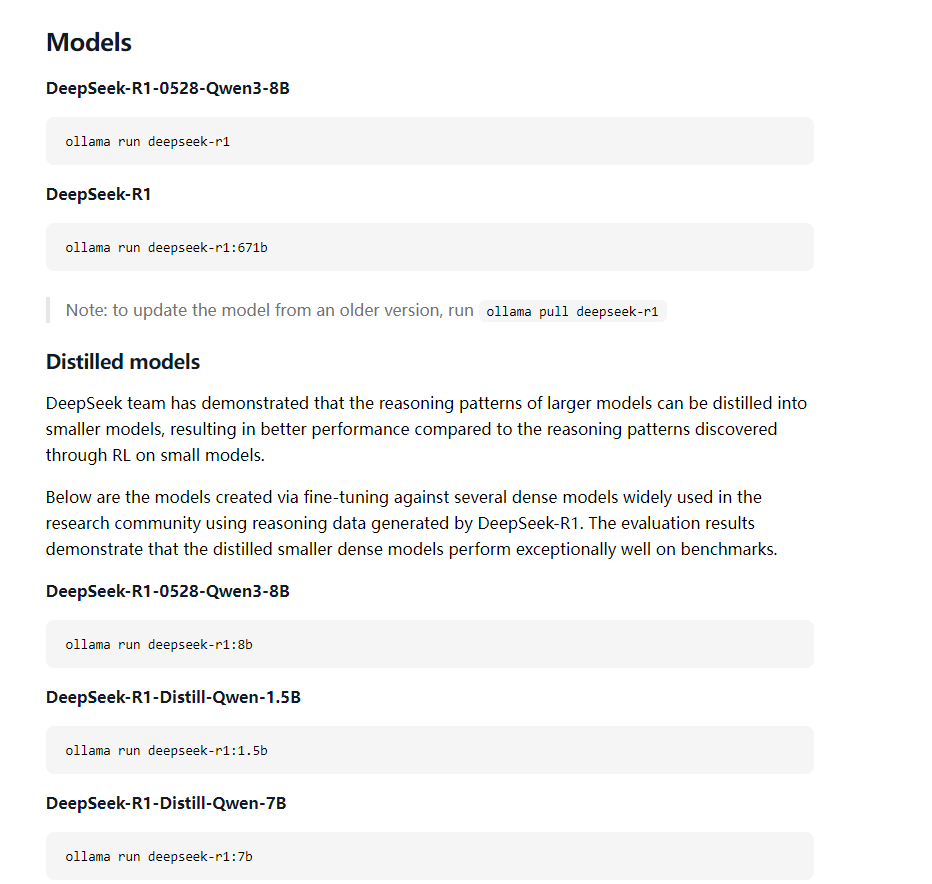

下载后默认是安装在C盘的,若不想装在C盘,则需要用指令安装,我这里用指令安装到D盘。

-

在OllamaSetup.exe所在目录打开cmd命令行,然后命令如下:

OllamaSetup.exe /DIR=你要安装的目录位置![image]()

-

-

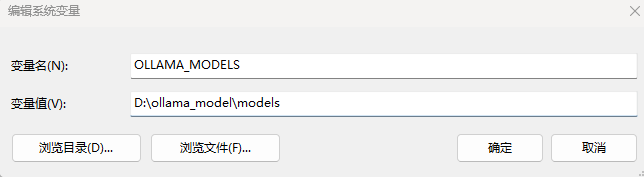

安装后,退出客户端(quit ollama),然后配置环境变量,设置ollama模型的存储路径

-

![image]()

-

![image]()

-

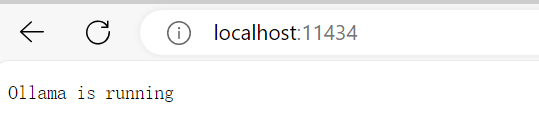

完成后可以在浏览器访问 http://localhost:11434/,显示ollama正在运行

-

![image]()

-

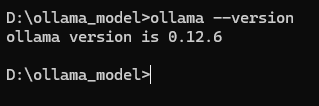

也可以通过cmd输入

ollama --version验证是否安装成功 -

![image]()

-

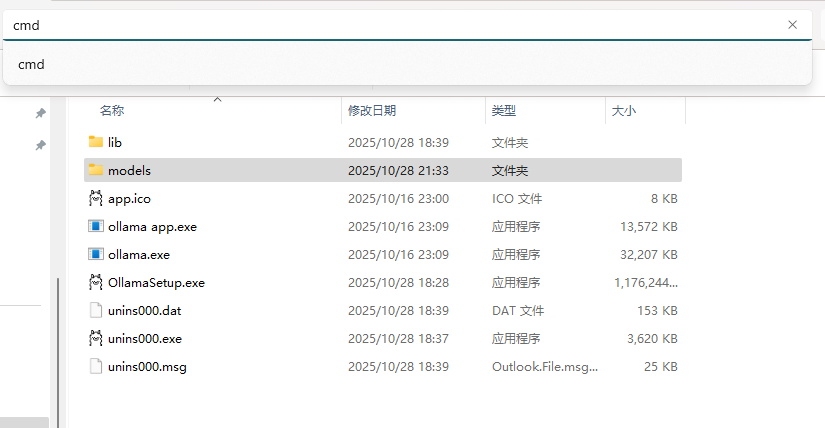

配置后再ollama.exe的所在位置打开cmd

-

![image]()

-

接下来运行模型

- 选择适合自己的模型即可,ollama会给出运行的命令

![image]()

-

这样就可以使用啦

-

![image]()

-

可以通过命令

ollama --help查看命令的使用,跟docker语法还是挺像的 -

![image]()

-

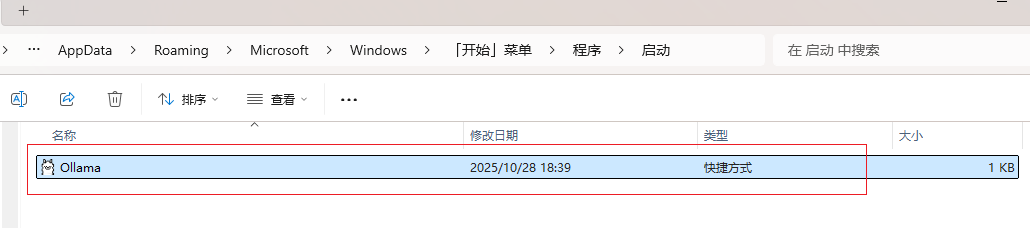

关于开机自启

- 访问一下路径,删除对应的Ollama.Ink文件

C:\Users\xxx\AppData\Roaming\Microsoft\Windows\Start Menu\Programs\Startup

![image]()