# 前言

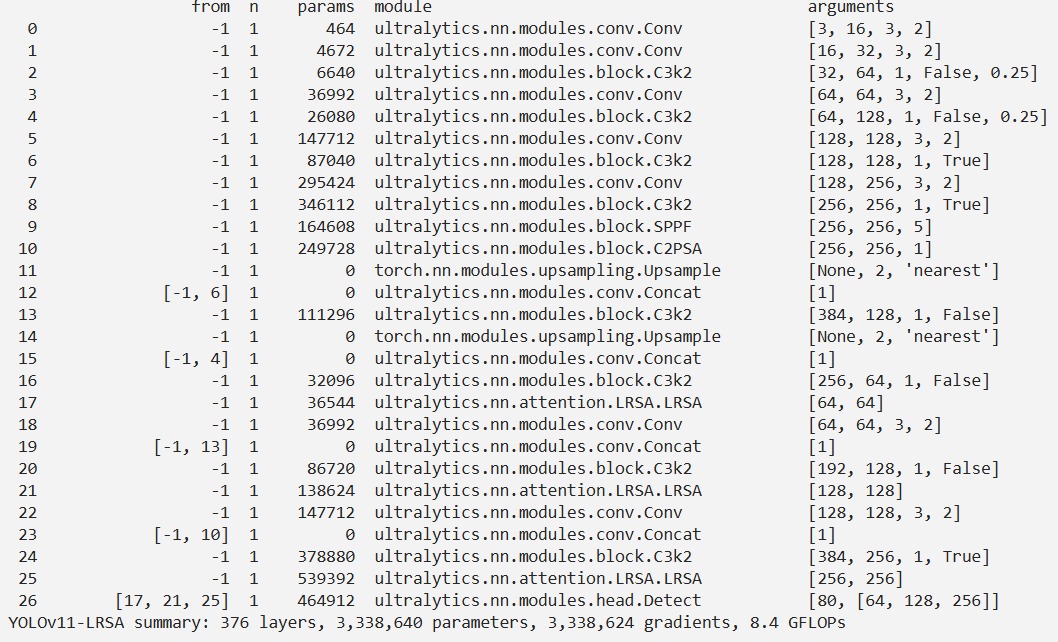

本文介绍了内容感知Token聚合网络(CATANet)中的局部区域自注意力(LRSA)模块在YOLOv11中的结合。基于Transformer的图像超分辨率方法存在计算复杂度高、捕捉长距离依赖能力受限等问题。LRSA作为CATANet的核心辅助模块,通过重叠补丁策略强化局部特征交互,补充局部细节。我们将相关代码加入指定目录,在ultralytics/nn/tasks.py中注册,配置yolov11 - LRSA.yaml文件,最后通过实验脚本和结果验证了方法的有效性。

文章目录: YOLOv11改进大全:卷积层、轻量化、注意力机制、损失函数、Backbone、SPPF、Neck、检测头全方位优化汇总

专栏链接: YOLOv11改进专栏

介绍

摘要

基于 Transformer 的方法在图像超分辨率(SR)等底层视觉任务中展现出了卓越的性能。然而,其计算复杂度随着空间分辨率的增加呈二次方级增长。一系列研究工作试图通过将低分辨率图像划分为局部窗口(local windows)、轴向条纹(axial stripes)或空洞窗口(dilated windows)来缓解这一问题。SR 通常利用图像的冗余性进行重建,而这种冗余不仅存在于局部区域,也存在于长距离区域中。然而,上述方法将注意力计算局限在与内容无关的局部区域内,直接限制了注意力机制捕捉长距离依赖关系的能力。为了解决这些问题,我们提出了一种轻量级的内容感知 Token 聚合网络(CATANet)。具体而言,我们提出了一种高效的内容感知 Token 聚合模块,用于聚合长距离且内容相似的 Token,该模块在所有图像 Token 间共享 Token 中心,且仅在训练阶段对其进行更新。随后,我们利用组内自注意力(intra-group self-attention)来实现长距离的信息交互。此外,我们还设计了一种组间交叉注意力(inter-group cross-attention),以进一步增强全局信息的交互。实验结果表明,与最先进的(SOTA)基于聚类的方法 SPIN 相比,我们的方法取得了更优越的性能,PSNR 最大提升了 0.33dB,且推理速度几乎翻倍。

文章链接

论文地址:论文地址

代码地址:代码地址

基本原理

Local-Region Self-Attention(LRSA,局部区域自注意力)是CATANet中负责细化图像局部细节的核心辅助模块,与捕捉长距离依赖的Token-Aggregation Block(TAB)形成功能互补,共同支撑轻量级图像超分辨率任务的高效性能。其设计核心是在低计算复杂度前提下,强化局部范围内像素/特征块的信息交互,弥补长距离注意力在细节还原上的不足。

一、核心定位与设计目标

1. 核心定位

作为CATANet深度特征提取阶段的关键组件(每个残差组RG包含TAB、LRSA和3×3卷积),LRSA专注于局部特征交互——在长距离依赖已被TAB捕捉后,进一步优化图像边缘、纹理等细粒度细节,避免因过度关注全局信息导致的局部模糊或 artifacts。

2. 设计目标

- 补充局部细节:与TAB的长距离信息捕捉形成“全局+局部”双重保障,提升超分辨率图像的细节还原度;

- 保持轻量化:采用高效结构设计,避免局部注意力计算引入过多冗余,适配手机等资源受限设备;

- 兼容并行计算:通过重叠补丁(Overlapping Patches)设计,兼顾局部交互效果与计算效率。

二、核心设计与工作原理

1. 结构来源与基础设计

LRSA参考了HPINet(Hierarchical Pixel Integration Network)的局部注意力结构,核心采用重叠补丁(Overlapping Patches) 策略:

- 将输入特征图划分为多个相互重叠的局部补丁(而非无重叠的独立窗口),确保相邻区域的特征能自然交互,避免窗口边界处的细节断裂;

- 所有补丁共享查询(Q)、键(K)、值(V)的权重矩阵,减少参数数量,降低计算复杂度。

2. 具体工作流程

设LRSA的输入为经过TAB处理后的特征图 ( X_o \in \mathbb{R}^{N \times d} )(其中 ( N ) 为特征token数量,( d ) 为特征维度),其工作流程可概括为3步:

- 补丁划分与特征投影:将输入特征图按固定尺寸(如8×8)划分为重叠补丁,每个补丁通过共享权重矩阵 ( WQ、WK、W^V \in \mathbb{R}^{d \times d} ) 分别投影为查询向量 ( Q )、键向量 ( K ) 和值向量 ( V );

- 局部自注意力计算:在每个补丁内部执行多头自注意力(MSA)运算,捕捉补丁内特征的局部依赖关系(如相邻像素的纹理关联、边缘连续性);

- 特征融合与输出:将所有补丁的注意力输出按原位置拼接,得到细化后的局部特征图 ( X_{out} \in \mathbb{R}^{N \times d} ),传递给后续的ConvFFN(卷积前馈网络)进一步优化。

3. 关键特性

- 重叠补丁设计:区别于SwinIR的非重叠固定窗口,重叠设计让局部注意力更平滑,避免“窗口效应”导致的图像边缘生硬;

- 权重共享:所有补丁共用一套Q/K/V投影权重,相比为每个补丁单独设计权重,参数数量减少约10%-20%(根据补丁数量调整),符合轻量化需求;

- 低计算复杂度:注意力计算仅局限于局部补丁内,复杂度与补丁尺寸呈线性关系,而非全局自注意力的二次复杂度,确保推理效率。

三、与其他注意力机制的区别与互补

1. 与CATANet内部核心注意力的互补

| 注意力机制 | 关注范围 | 核心功能 | 计算复杂度 |

|---|---|---|---|

| LRSA | 局部补丁(如8×8) | 细化边缘、纹理等局部细节 | 线性复杂度(与补丁尺寸相关) |

| IASA(组内自注意力) | 跨图像的内容相似组 | 捕捉长距离依赖 | 线性复杂度(与组内token数量相关) |

| IRCA(组间交叉注意力) | 组与全局token中心 | 强化全局信息交互 | 低复杂度(( M \ll N ),( M ) 为token中心数量) |

LRSA的核心价值的是“补位”——IASA和IRCA解决了“长距离相似信息交互”问题,但可能忽略局部像素的精细关联,而LRSA专注于局部细节修复,三者形成“全局依赖+局部细节”的完整覆盖。

2. 与传统局部注意力的区别

- 相比SwinIR的“固定窗口注意力”:LRSA的重叠补丁设计避免了窗口边界的信息割裂,细节还原更自然;

- 相比NLSA(非局部稀疏注意力):LRSA不依赖哈希分组,无需处理哈希冲突,分组更稳定,且计算更高效;

- 相比CNN的局部卷积:LRSA通过自注意力机制能自适应捕捉局部特征的关联强度(如强边缘与弱纹理的差异化关注),而卷积的局部交互是固定权重的,灵活性更弱。

核心代码

class LRSA(nn.Module):"""Attention module.Args:dim (int): Base channels.num (int): Number of blocks.qk_dim (int): Channels of query and key in Attention.mlp_dim (int): Channels of hidden mlp in Mlp.heads (int): Head numbers of Attention."""def __init__(self, dim, qk_dim, mlp_dim,heads=1):super().__init__()self.layer = nn.ModuleList([PreNorm(dim, Attention(dim, heads, qk_dim)),PreNorm(dim, ConvFFN(dim, mlp_dim))])def forward(self, x, ps):step = ps - 2crop_x, nh, nw = patch_divide(x, step, ps) # (b, n, c, ps, ps)b, n, c, ph, pw = crop_x.shapecrop_x = rearrange(crop_x, 'b n c h w -> (b n) (h w) c')attn, ff = self.layercrop_x = attn(crop_x) + crop_xcrop_x = rearrange(crop_x, '(b n) (h w) c -> b n c h w', n=n, w=pw)x = patch_reverse(crop_x, x, step, ps)_, _, h, w = x.shapex = rearrange(x, 'b c h w-> b (h w) c')x = ff(x, x_size=(h, w)) + xx = rearrange(x, 'b (h w) c->b c h w', h=h)return x

实验

脚本

import warnings

warnings.filterwarnings('ignore')

from ultralytics import YOLOif __name__ == '__main__':

# 修改为自己的配置文件地址model = YOLO('/root/ultralytics-main/ultralytics/cfg/models/11/yolov11-LRSA.yaml')

# 修改为自己的数据集地址model.train(data='/root/ultralytics-main/ultralytics/cfg/datasets/coco8.yaml',cache=False,imgsz=640,epochs=10,single_cls=False, # 是否是单类别检测batch=8,close_mosaic=10,workers=0,optimizer='SGD',amp=True,project='runs/train',name='LRSA',)结果