DeepSeek V4 来了!超越 Claude Sonnet 4.5,赶紧对接 Claude Code 体验一把

JeecgBoot AI专题研究 | 把 Claude Code 接入 DeepSeek V4-Pro 的真实体验与避坑记录

本文记录我将 Claude Code 对接 DeepSeek 最新模型(V4-Pro)后的真实体验,测试了 Skills 自动化查询和积木报表 AI 建表两个场景——有惊喜,也踩到了一个藏在 "1M 超长上下文" 光环下的巨坑。

背景:为什么要替换掉原生 Claude?

Claude Code 是目前公认最强的 AI 编程工具之一,但原版的 Anthropic API 费用不低——Opus 4.6 的输入价格高达 $15 / 百万 tokens。作为一个每天重度使用 Claude Code 的开发者,API 账单是绕不开的问题。

今天 DeepSeek 在 Hugging Face 发布了 V4 系列预览版,包含 V4-Pro(1.6T 参数 / 49B 激活)和 V4-Flash(284B 参数 / 13B 激活),并且提供了兼容 Anthropic 协议的 API 端点。这意味着:理论上只需改一行配置,就能用 DeepSeek 驱动 Claude Code。

我立刻动手试了。

配置过程:1 分钟完成接入

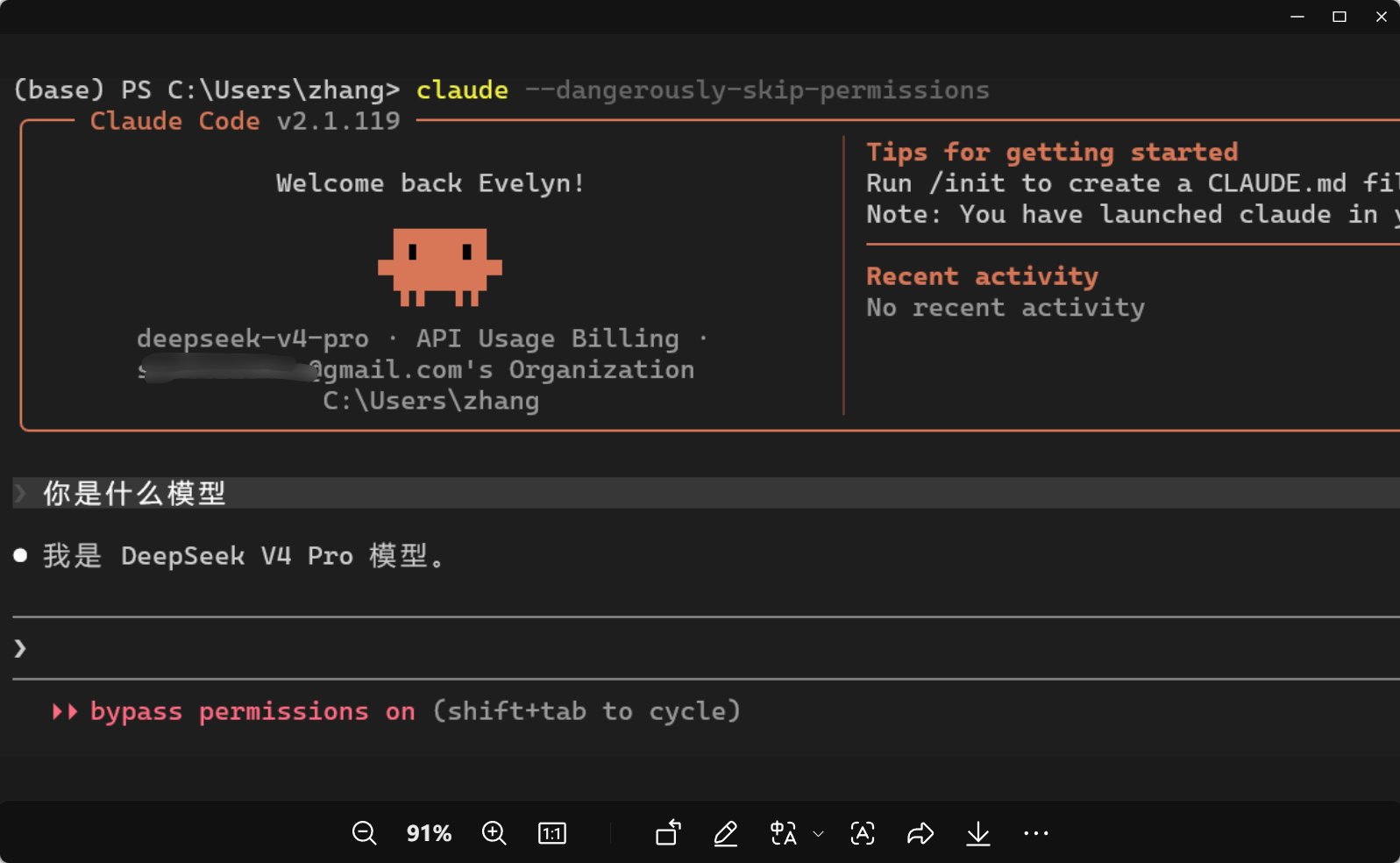

核心配置其实非常简单,DeepSeek 提供了完整的 Anthropic API 兼容层,只需要在 Claude Code 的配置文件中修改几个环境变量:

{"env": {"ANTHROPIC_BASE_URL": "https://api.deepseek.com/anthropic","ANTHROPIC_AUTH_TOKEN": "${DEEPSEEK_API_KEY}","API_TIMEOUT_MS": "3000000","ANTHROPIC_MODEL": "deepseek-v4-pro","ANTHROPIC_SMALL_FAST_MODEL": "deepseek-v4-flash","ANTHROPIC_DEFAULT_SONNET_MODEL": "deepseek-v4-pro","ANTHROPIC_DEFAULT_OPUS_MODEL": "deepseek-v4-pro","ANTHROPIC_DEFAULT_HAIKU_MODEL": "deepseek-v4-flash","CLAUDE_CODE_SUBAGENT_MODEL": "deepseek-v4-pro","CLAUDE_CODE_EFFORT_LEVEL": "max"},"model": "deepseek-v4-pro"

}

逻辑非常清晰:重量级任务(复杂代码、深度推理)走 V4-Pro,轻量任务(工具调用、文件读写、快速问答)走 V4-Flash。两档模型分工明确,既保住能力上限,又控制成本。

配置完成后,Claude Code 启动界面上已经清楚地显示 deepseek-v4-pro · API Usage Billing,问它 "你是什么模型",回答干脆利落:

我是 DeepSeek V4 Pro 模型。

身份确认,接下来是正题——实际测试。

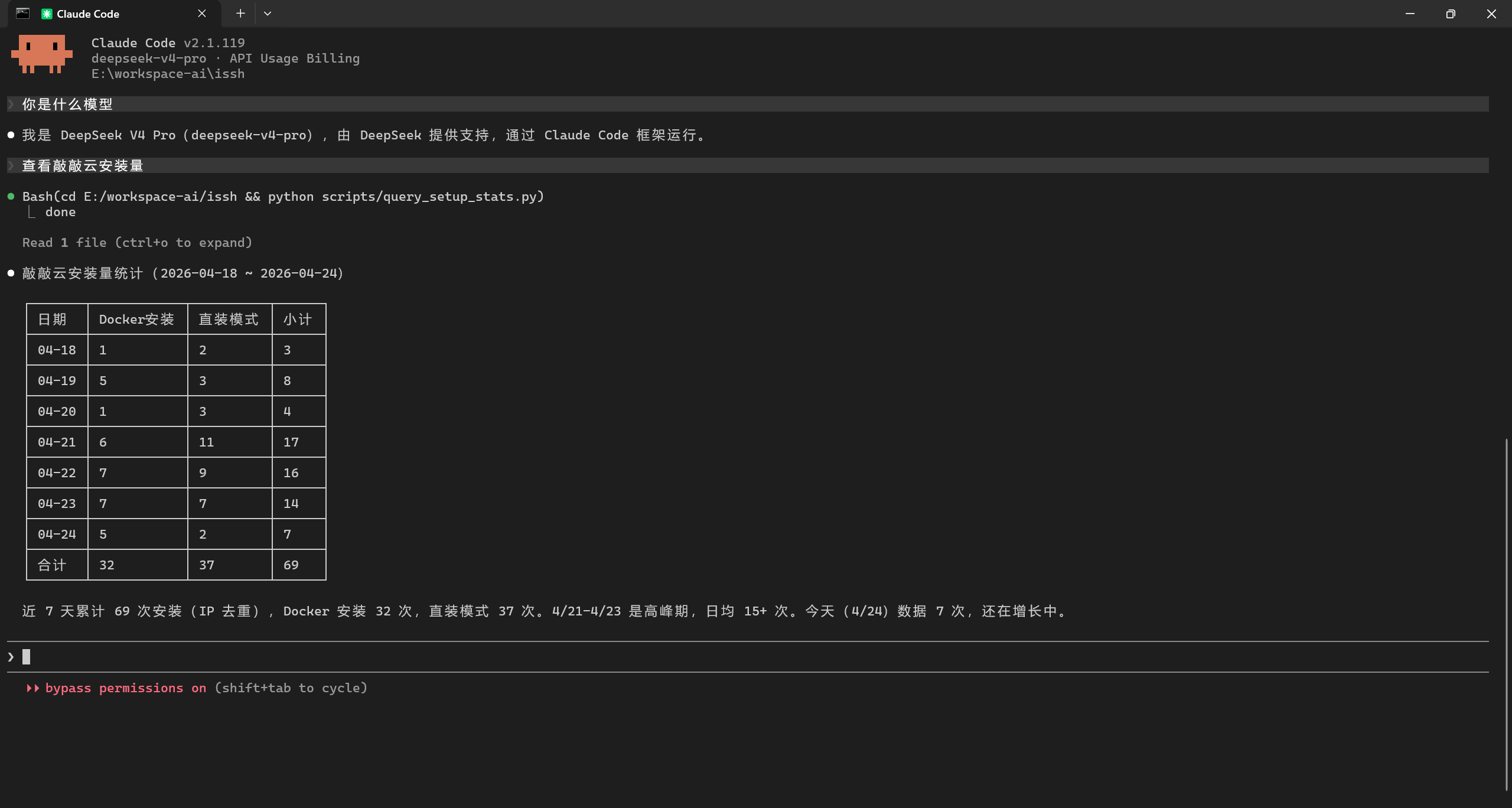

测试一:Skills 自动化查询敲敲云安装量

测试目标:让 Claude Code 调用预设的 Skills 脚本,查询敲敲云产品近 7 天的安装量数据,并给出分析。

这类任务考验的是模型的工具调用能力和数据理解能力——要能正确执行脚本、读懂返回数据、输出有意义的分析。

结果令人满意。指令下达后,模型迅速调用了 scripts/query_setup_stats.py,脚本执行完成后,它直接输出了结构清晰的统计表格:

| 日期 | Docker 安装 | 直装模式 | 小计 |

|---|---|---|---|

| 04-18 | 1 | 2 | 3 |

| 04-19 | 5 | 3 | 8 |

| 04-20 | 1 | 3 | 4 |

| 04-21 | 6 | 11 | 17 |

| 04-22 | 7 | 9 | 16 |

| 04-23 | 7 | 7 | 14 |

| 04-24 | 5 | 2 | 7 |

| 合计 | 32 | 37 | 69 |

模型随即给出分析:近 7 天累计 69 次安装(IP 去重),4/21–4/23 是高峰期,日均 15+ 次;今天(4/24)数据 7 次,还在增长中。

整个过程速度很快,数据完全正确,没有幻觉,没有多余废话。V4-Pro 在这类结构化数据处理 + 工具调用场景下表现非常稳。

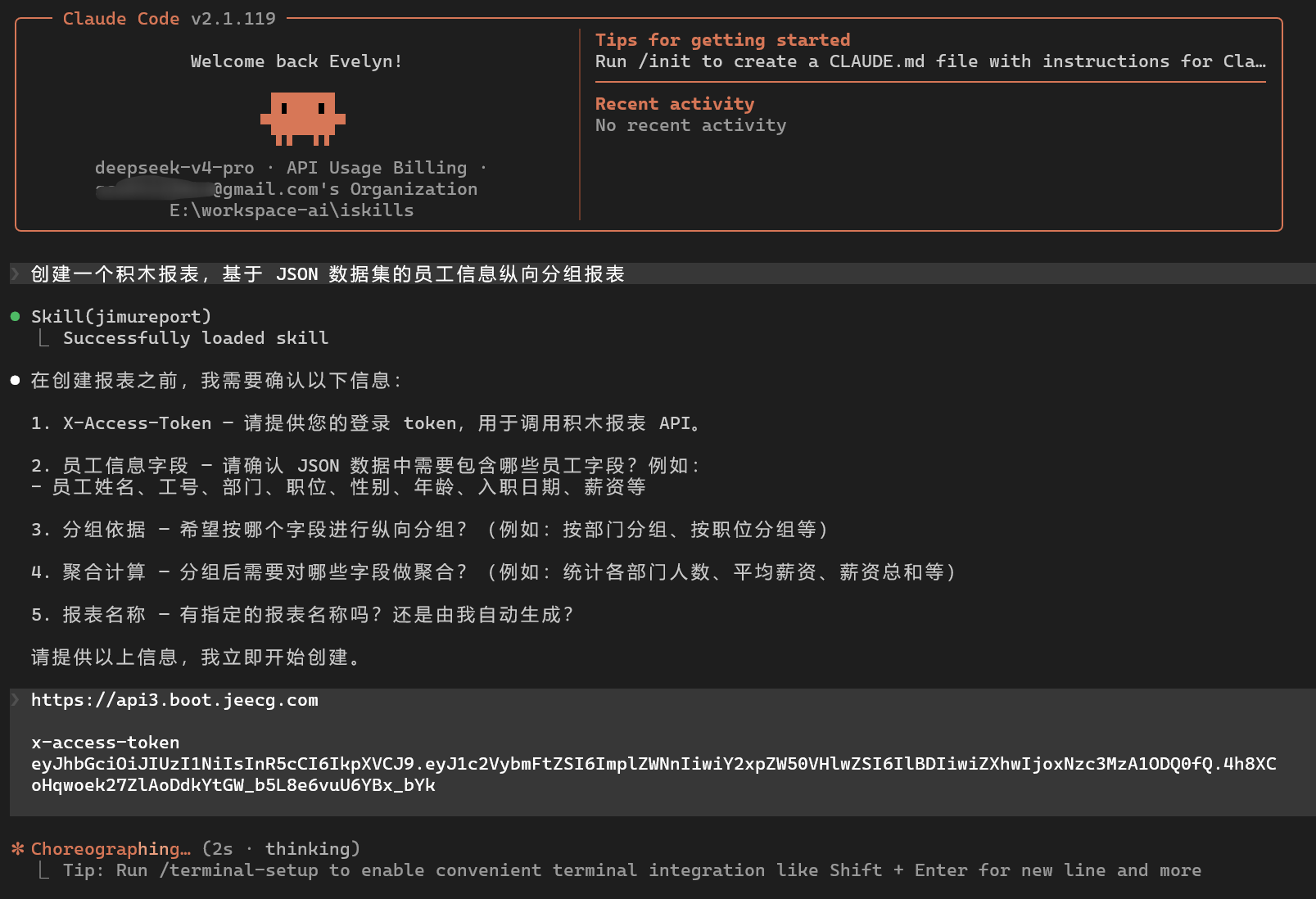

测试二:积木报表 AI 建表——盲猜出了正确答案

测试目标:让 Claude Code 调用积木报表(JiMu Report)的 AI 建表 Skills,自动创建一张员工信息纵向分组报表,要求按部门分组并显示小计。

这个任务比第一个复杂得多——它涉及报表 DSL 配置的生成,需要模型理解 "分组报表"、"纵向合并"、"小计行" 等专业概念,并且输出格式精确到位。

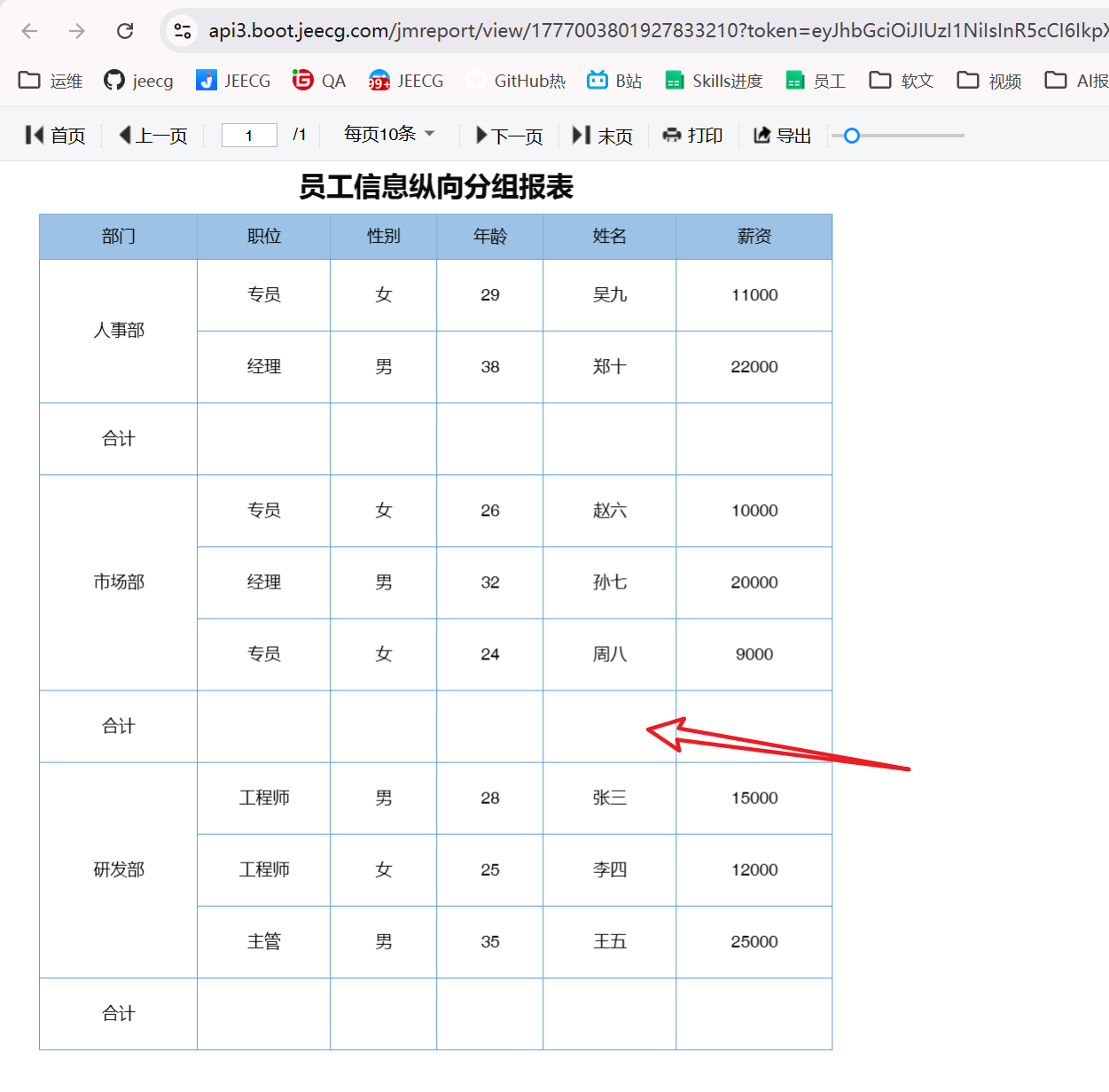

第一轮:报表出来了,但合计行是空的

模型第一次生成配置后,报表渲染出来,结构基本正确——按部门(人事部、市场部、研发部)纵向分组,每个部门内的员工明细都显示出来了。但有一个明显问题:合计行完全是空的,年龄、人数、薪资的小计数据一个都没有显示。

我把截图发给它,配上一句描述:"合计值配置不对。"

第二轮:看不见图,却猜对了病根

这里出现了一个既尴尬又有趣的细节。

模型收到截图后,在界面上诚实地打印出一行字:

我无法直接查看图片,但根据已知的纵向分组合计坑点,问题应该是数值列(薪资、年龄)缺少显式的聚合属性。让我获取报表当前设计并修复。

没错——它看不见图片,但它没有放弃,而是调用工具读取了报表当前的 JSON 配置文件,然后凭借对 "纵向分组报表合计行常见问题" 的领域知识,直接定位到了问题:小计行的字段缺少 sum、avg、count 等聚合表达式绑定,导致渲染时数据为空。

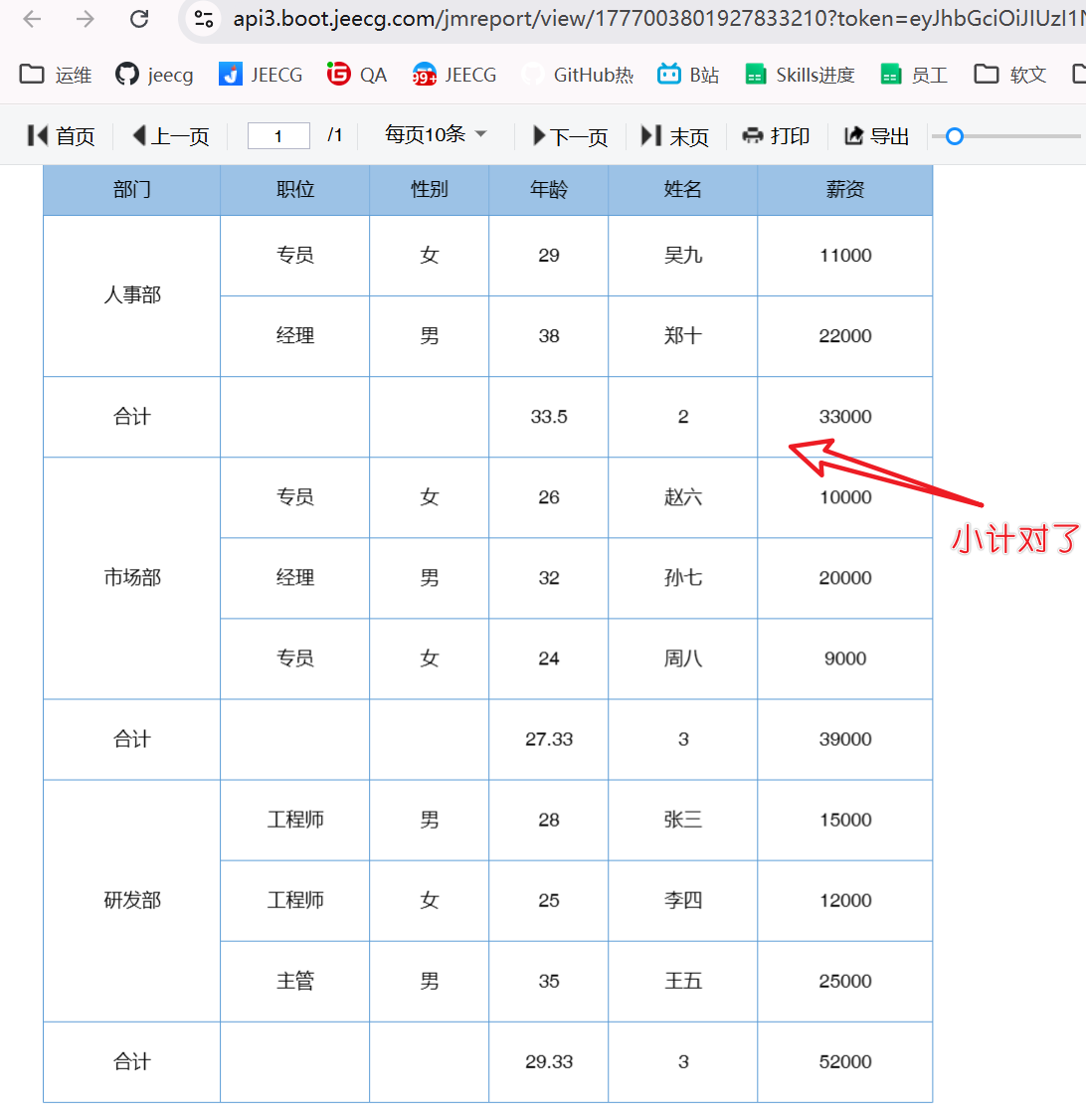

它重新生成了配置,在合计行的对应字段上补充了聚合属性,再次渲染后:

- 人事部合计:年龄均值 33.5,人数 2,薪资合计 33,000 ✓

- 市场部合计:年龄均值 27.33,人数 3,薪资合计 39,000 ✓

- 研发部合计:年龄均值 29.33,人数 3,薪资合计 52,000 ✓

所有小计全部正确。

这一幕揭示了什么

这个过程的关键不是 "修好了",而是修好的方式——它没有依赖视觉信息,而是通过读取配置文件 + 领域知识推断,独立完成了诊断和修复。换句话说,即便图片这条路走不通,它还能找到另一条路绕过去。

这是 Agent 能力的体现,也恰好暴露了接下来要说的那个坑。

巨坑预警:1M 上下文 ≠ 支持图片

DeepSeek V4-Pro 最亮眼的规格之一是 1,000,000 tokens 的超长上下文,乍一看比 Claude 原版还要豪横。但当我发送截图时,才发现了这个藏在光环下的盲区:

V4-Pro 当前版本是纯文本模型,完全不支持图片输入。

Claude Code 在发送图片时,V4-Pro 会收到一个占位符 [Image #1],但对实际图像内容毫无感知。所以你看到的那句 "我无法直接查看图片" 不是谦虚,是真的看不见。

对于日常编程工作流,这个限制影响面相当广:

- 截图报错让模型分析 → ❌ 看不见

- 发 UI 设计稿让模型写代码 → ❌ 看不见

- 发报表渲染结果让模型诊断问题 → ❌ 看不见

- 粘贴终端截图 → ❌ 看不见

1M 上下文能塞进去整个代码仓库,但塞不进去一张 PNG。

目前的折中办法:当需要处理图片时,临时去掉 ANTHROPIC_BASE_URL 配置,让请求回落到 Anthropic 原生 API,用完再切回来。麻烦,但能用。DeepSeek V4 的 Vision 模式已经在规划中,API 开放后这个问题会从根本上解决。

综合感受

经过这两轮测试,对 Claude Code + DeepSeek V4-Pro 的组合有几点直观感受:

表现亮眼的地方:

- 兼容性几乎无感:配置完成后,Claude Code 的所有功能正常运行,Skills、工具调用、多步骤 Agent 任务都能跑通,完全感受不到 "换了模型"。

- 工具调用稳定:脚本执行、文件读写这类结构化任务,V4-Pro 准确率高、响应快,没有废话也没有幻觉。

- 领域推理能力强:即使在无法看图的情况下,模型能通过读取配置文件 + 领域知识推断定位到问题,这种 "绕路解决" 的能力很实用。

- 成本压缩明显:相比原生 Claude Opus,API 成本预估节省 90%+。

需要踩坑提前知道的:

- 🚨 不支持图片(重要):1M 上下文是真的,但图片输入不支持。Claude Code 里发截图,模型只会收到占位符,完全看不见内容。这是目前最影响日常使用的限制。

- 部分复杂任务需要引导:像报表建表这类专业 DSL 任务,第一次不一定配置到位,但接受反馈后自修正能力很强。

- 超时要设长一点:V4-Pro 在 max effort 模式下推理时间较长,

API_TIMEOUT_MS建议设 600000(10 分钟)以上。

总结

把 Claude Code 对接 DeepSeek V4-Pro,配置成本极低,三分钟搞定,换来的是开源最强 Agent 编程模型 + 极低 API 成本 + 完整的 Claude Code 工具链。

但有一点要想清楚再切换:如果你的工作流依赖截图、UI 稿、图片输入,现在切换会很痛。等 DeepSeek V4 的 Vision 模式开放 API,这套方案才算真正补全了最后一块拼图。

在那之前——纯代码任务、脚本自动化、文本推理,放心用;涉及图片的,暂时留一个 Claude 原生的后路。

测试环境:Claude Code v2.1.119,DeepSeek V4-Pro(deepseek-v4-pro),2026-04-24

本文为 JeecgBoot AI 专题研究系列文章。