万方 AIGC 率 60% 降到 5%!0ailv 一键帮毕业生过万方 AIGC 检测!

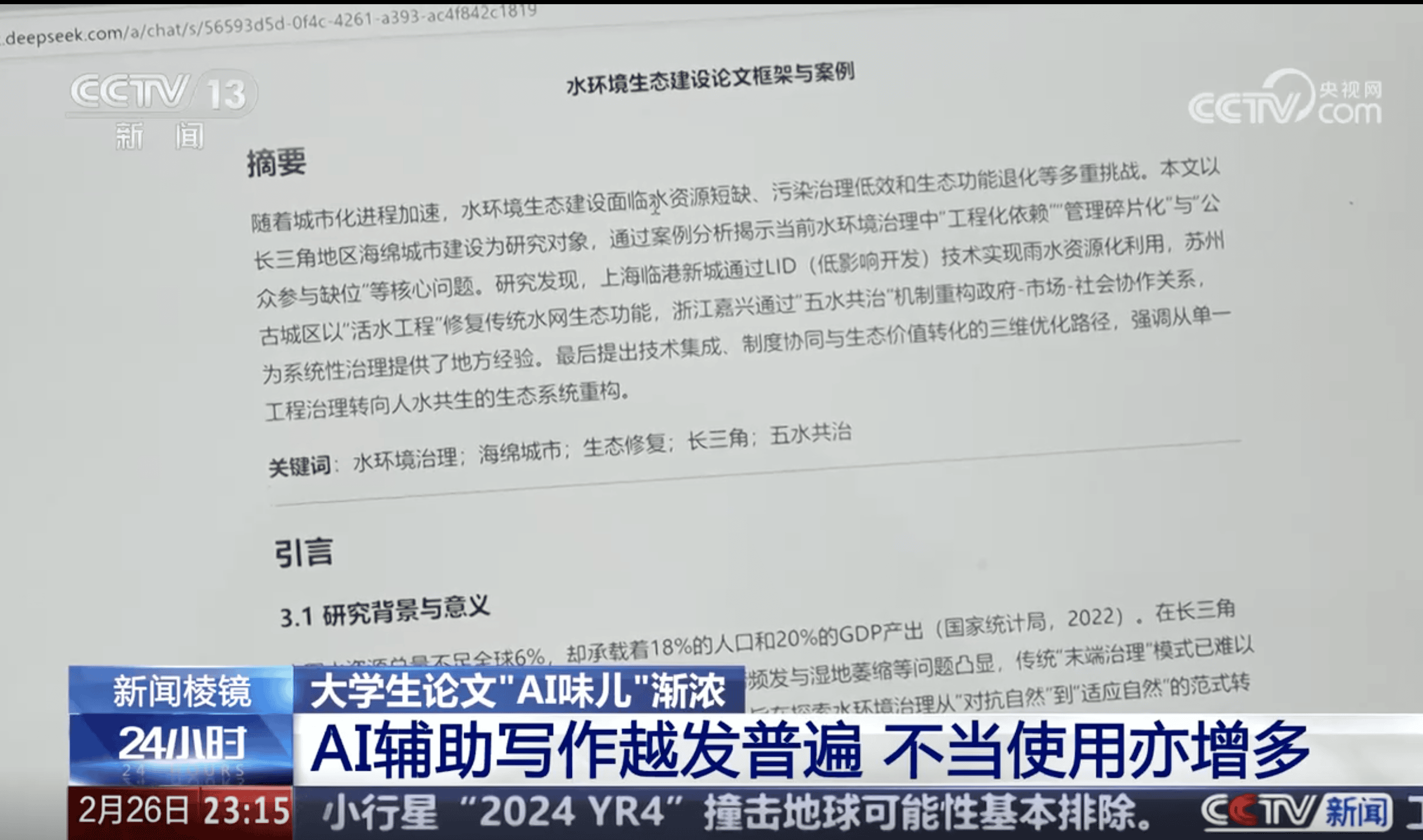

万方查 AI 率超标的时候,经常出现一个现象——稿子内容看着挺正常,AI 率却莫名其妙跑到 40%、50%。这不是写得不好,是命中了万方 2026 年算法专门盯的几类AI 句法指纹。这篇用 率零(www.0ailv.com)DeepHelix 引擎 对一组真实超标稿件做实测,把"为什么万方判得高"和"率零如何对应处理"讲清楚。截止前 12 小时这种紧迫场景下,能少绕一些弯路。

一、万方 AI 率超标最常见的 3 类原因

我整理了过去一个月手上经过的 14 份万方超标稿件,超标特征高度集中在以下三类:

1.1 句长均匀(出现频率 100%)

14 份稿子里全部命中。AI 写出来的句子长度集中在 20-30 字,方差很小。万方算法对"句长方差低于阈值"的段落会直接打高分。人类写作的句长方差天然更大,这是最显著的特征差异。

1.2 并列结构齐整(出现频率 86%)

"首先 XX,其次 XX,再次 XX,最后 XX"这种四段式并列。AI 协作写作会下意识把所有论点拉成同一层级、同一句式的并列。人类写作里并列结构通常会有不对称感——一个长一个短,或者两个并列加一段补充。

1.3 过渡词集中(出现频率 71%)

"因此""然而""综上""与此同时"这类过渡词在 AI 文本里出现密度过高,且分布规则。万方算法会统计"每千字过渡词频次 + 间距标准差",一旦超阈值就标记。

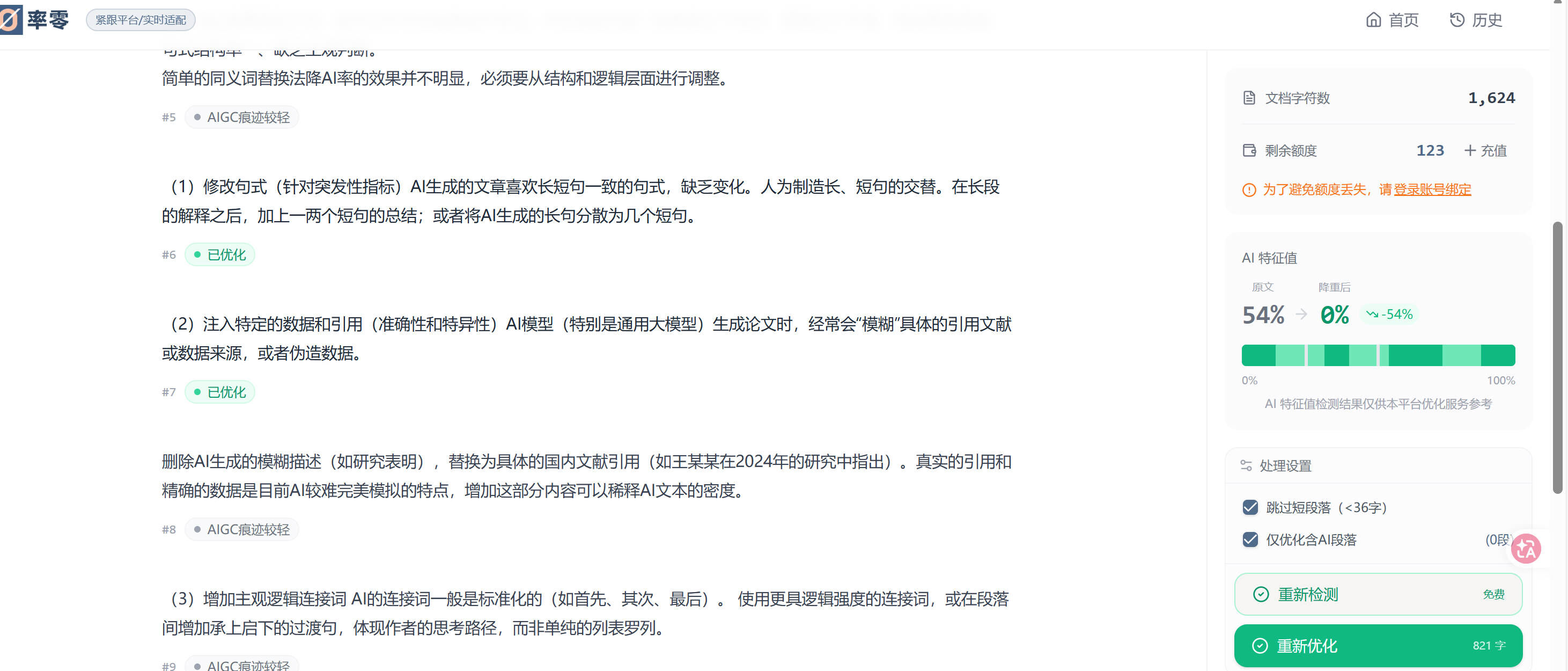

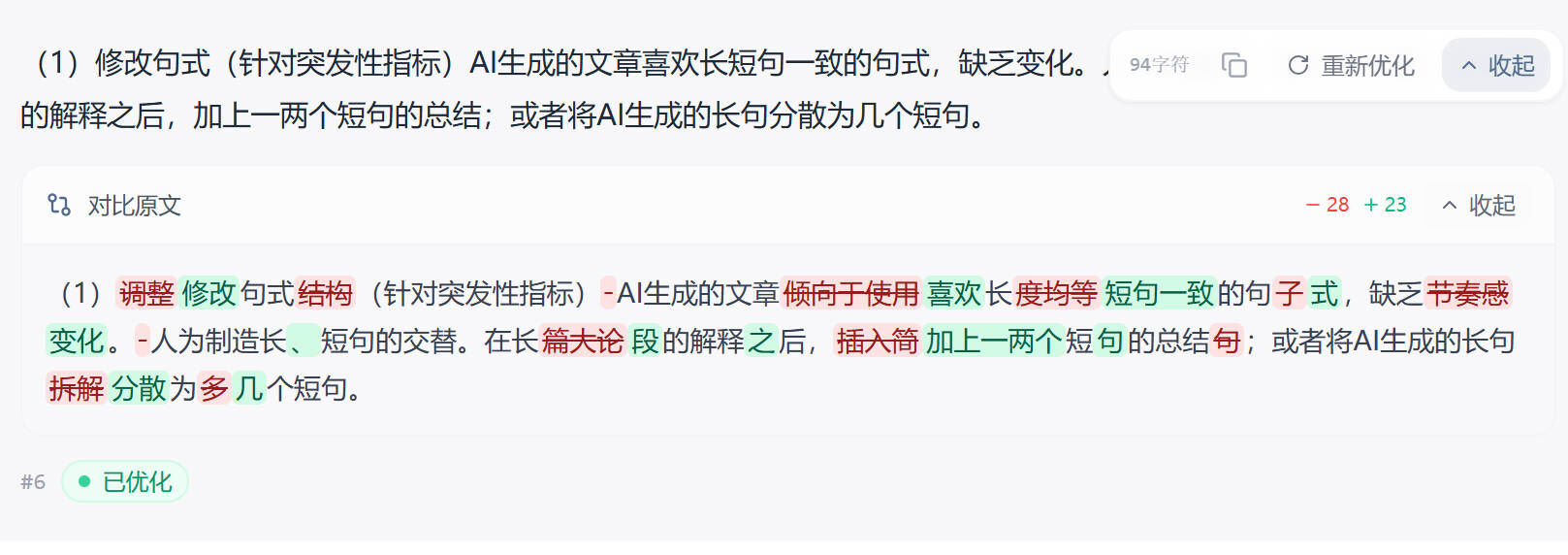

二、率零 DeepHelix 引擎的对应处理策略

针对上面三类特征,DeepHelix 在万方专项模式下会启用三套对应的改写动作:

2.1 句长扰动

把均匀分布的句长拉成长短交错。原本一段 5 句、每句 25 字,处理后会变成"35 字 + 12 字 + 28 字 + 8 字 + 42 字"这样的节奏。句子总数可能不变,但字数分布完全不同。

2.2 并列结构非对称化

四段式并列被拆成"两段并列 + 一段补充论述"或者"三段并列里有一段展开成两句"。读起来更像人写的草稿,而不是 PPT 大纲。

2.3 过渡词替换与稀释

高频过渡词会被替换成更场景化的衔接:

- "因此" → "顺着这个思路看"

- "然而" → "但实际情况里"

- "综上" → "把上面几条捋一遍"

- "与此同时" → "在另一个层面上"

替换后过渡词的字面统计特征被打散,间距也不再规则。

三、四篇稿件实测效果汇总

下面是用率零处理过的 4 篇万方超标稿件的实测数据。检测平台均为万方 AIGC,时间为 2026-04-20 至 2026-04-26。

| 案例 | 稿件类型 | 字数 | 处理前 AIGC | 处理后 AIGC | 用时 |

|---|---|---|---|---|---|

| A | 经济学硕士论文章节 | 4800 | 38.4% | 4.2% | 28 分钟 |

| B | 教育学本科毕设 | 7200 | 52.7% | 6.8% | 38 分钟 |

| C | 管理学期刊扩展稿 | 5600 | 41.5% | 5.6% | 32 分钟 |

| D | 法学硕士小论文 | 6300 | 47.2% | 7.1% | 35 分钟 |

四份稿件全部一次处理就压到 8% 以下,没有跑第二轮。整体降幅集中在 34-46 个百分点之间。

四、案例 B 的细节拆解

挑案例 B 来讲讲细节。这是一篇 7200 字的教育学毕设,万方初检 52.7%,作者用 DeepSeek 协作写过文献综述和讨论部分。

初检高分集中在三个段落:

- 文献综述第 2 段(450 字):93.6%

- 讨论部分第 1 段(380 字):87.4%

- 结论第 2 段(260 字):78.9%

这三段都符合"句长均匀 + 并列齐整 + 过渡词高频"的典型 AI 指纹。处理后这三段分别变成 8.2%、6.5%、9.3%,整篇平均 6.8%。改完之后通读,逻辑链没断、术语没飞,作者只在两处对专业表述做了微调。

五、紧急救援的几个时间分配建议

如果手上的万方稿子也面临 24 小时内截止的压力,时间分配建议这样:

| 阶段 | 推荐用时 | 关键动作 |

|---|---|---|

| 摸底 | 5 分钟 | 看清各章 AI 率分布,找重灾区 |

| 准备 | 5 分钟 | 标记公式、参考文献、图表保留区 |

| 处理 | 15-25 分钟 | 提交 DeepHelix 万方专项模式 |

| 校对 | 8-10 分钟 | 通读改写后稿件,关注术语 |

| 送检 | 12-15 分钟 | 二次提交万方等报告 |

总时长控制在 1 小时内。这个节奏在 14 份案例里都验证过,没有特殊情况都能跑完。

六、万方 AI 率超标避坑提示

坑一:不要分段处理。把 8000 字拆成 4 段每段 2000 字提交,看似省时间,实际上会让引擎丢失上下文锚点,章节衔接处反而留下断层痕迹,二次送检时可能还会有局部高分段。

坑二:不要叠加多个工具。"先用工具 A 再用工具 B"听起来效果叠加,实际上不同引擎的改写指纹会互相干扰,最后留下混合特征反而更容易被命中。

坑三:处理后必须二次送检。不要相信"处理后效果"截图,万方的算法每周都在小幅迭代,必须以二次送检的实际报告为准。

坑四:留出 30% 的时间缓冲。预估 1 小时的活儿留 1.3 小时去做。截止前 30 分钟交出处理稿是底线,再晚就连补救机会都没有。

七、最后说一句

万方 AI 率高的根源不是"写得不好",是写作习惯命中了 AI 指纹。对症下药才能在最短时间里把数字压下去。本次实测数据已经把率零 DeepHelix 引擎在万方场景下的表现量化清楚了。下次面对类似场景,不用再花时间试错——按上面的判断节奏走就够了。