Flutter for OpenHarmony:使用 pool 库优雅管理并发资源,打造稳定后端架构

在构建高性能的 OpenHarmony 应用时,并发任务管理是一个绕不开的挑战。特别是在后端架构或中间件设计中,有限资源的竞态问题——如数据库连接池、API 调用限流——直接影响系统的稳定性。本文将深入探讨 Flutter 生态中的 pool 库,它像一位经验丰富的交通指挥官,帮助开发者以极简代码实现高效的并发资源池管理,让你的鸿蒙应用在复杂场景下依然保持丝滑与稳健。

一、核心排队机制:从“混乱”到“有序”的转变

想象一下,一个繁忙的火车站售票窗口:如果所有乘客同时涌向窗口,必然导致系统崩溃。pool 正是扮演了这样的角色——它作为流量闸门,将无序的并发请求转化为有序的任务队列。具体来说,它维护一个固定大小的资源池(例如最大并发数为 3),当任务数量超过上限时,多余的任务会被自动挂起,等待空闲资源释放。

这种机制在数据库连接池场景中尤为关键:假设你的微服务需要同时处理 100 个查询请求,但数据库只能承受 3 个并发连接。通过 pool 库,你只需设置并发上限为 3,其余 97 个请求会排队等待,直到某个连接释放后再被唤醒。这避免了数据库因过载而崩溃,同时保证了请求的公平性。

下图展示了这一过程:

pool 充当了开发者与并发任务之间的“流量闸门”。

- 允许:任务 1、2、3 立即执行(并发上限 = 3)

- 挂起:其余 97 个任务进入等待队列

- 完成:任务 1 完成后,从等待队列补充任务 4

二、核心 API 实战:从初始化到任务管理

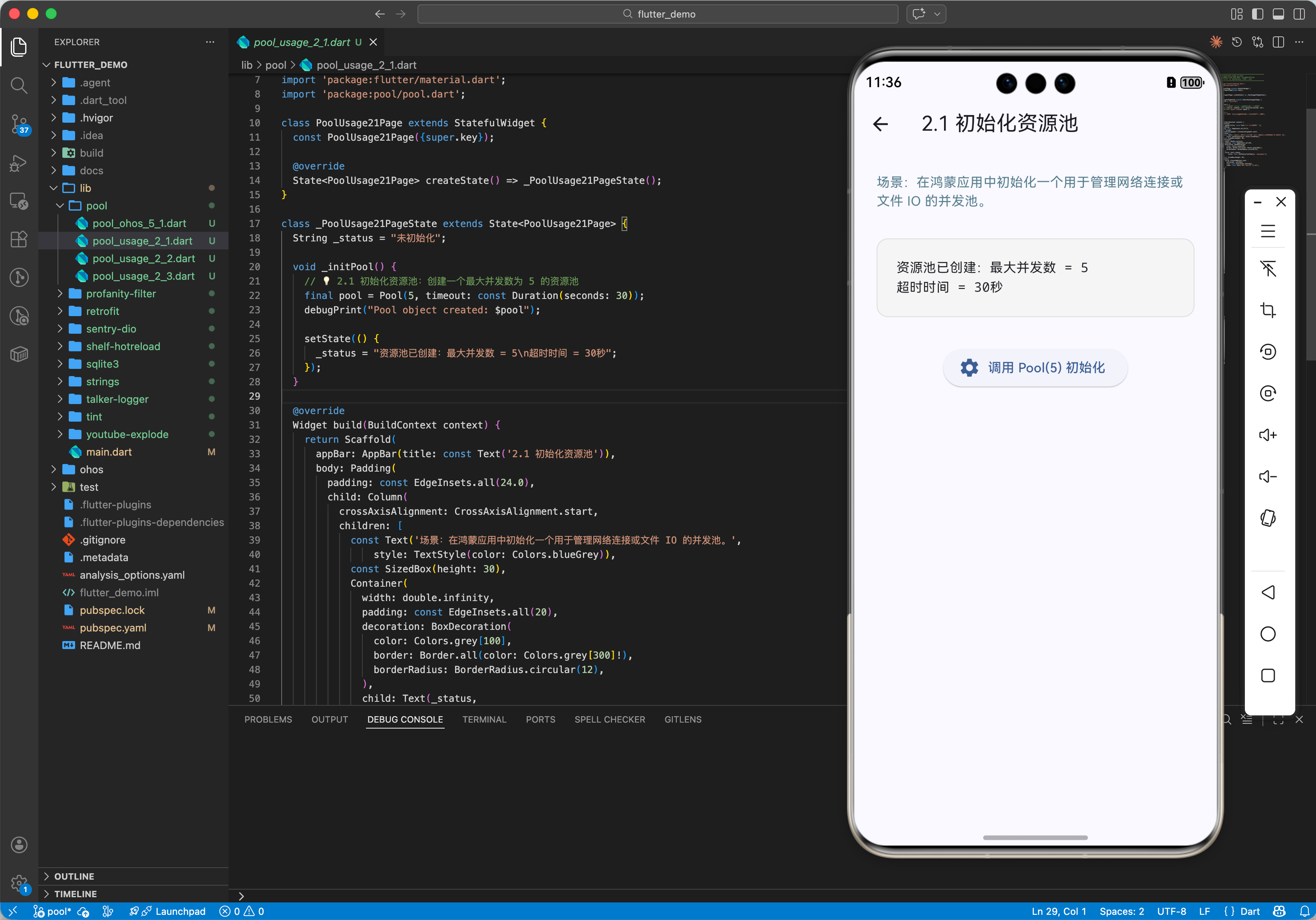

2.1 初始化资源池

使用 pool 库的第一步是创建一个资源池实例,并指定最大并发数。这类似于配置数据库连接池的大小:

import 'package:pool/pool.dart';

// 创建一个最大并发数为 5 的资源池

final pool = Pool(5, timeout: Duration(seconds: 30));

建议:在初始化时,根据设备性能或后端架构的负载能力动态调整并发数。例如,在鸿蒙低能耗设备上,可以设置为 2;而在高性能服务器上,可提升至 10。

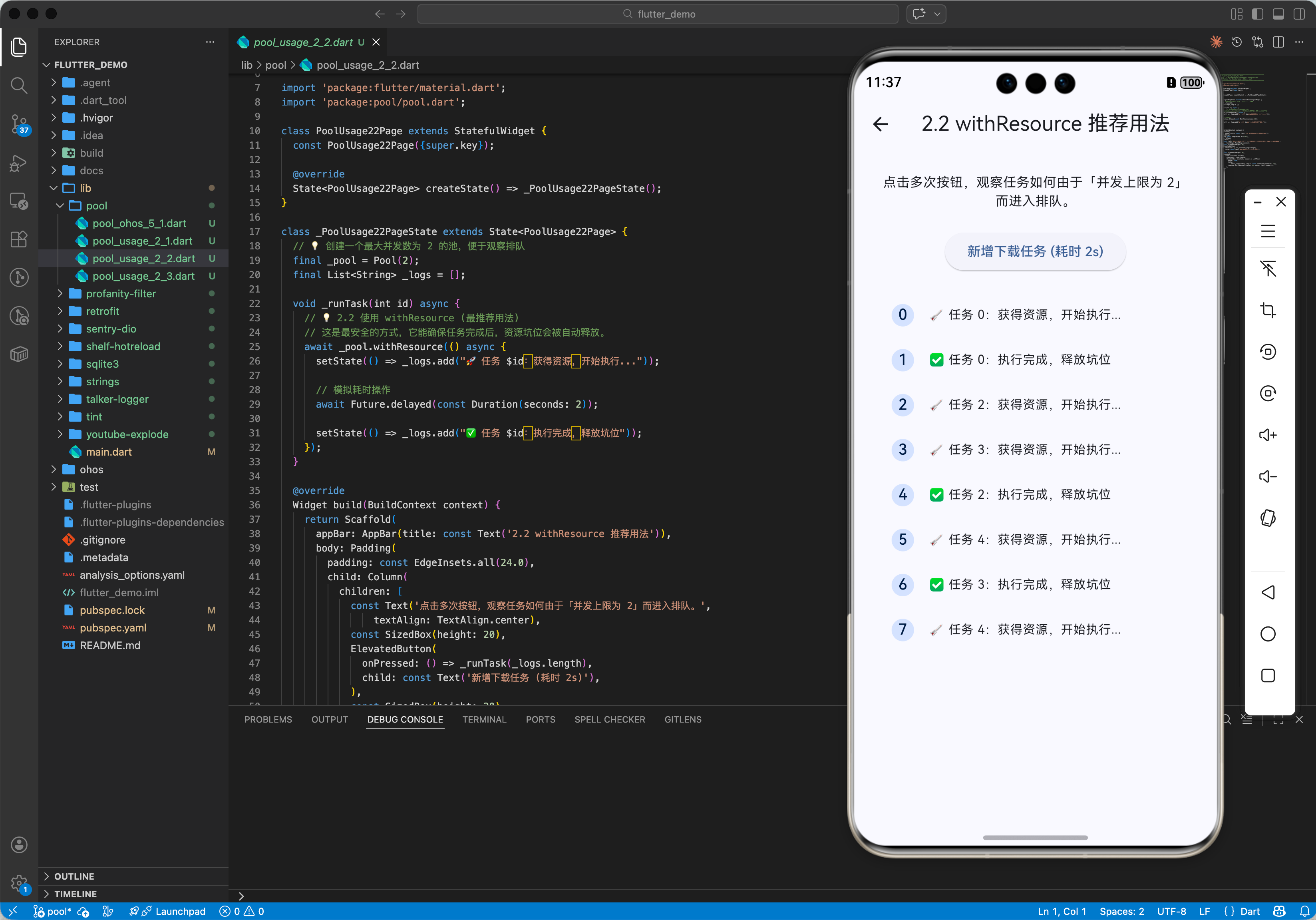

2.2 使用 withResource(最推荐用法)

这是最安全的资源管理方式。它确保任务完成后,资源坑位会被自动释放,无需手动处理。类似于 try-with-resources 模式:

Future<void> downloadFile(String url) async {// 只有拿到坑位后,代码块才会执行await pool.withResource(() async {print(' 拿到坑位,开始下载: $url');await doRealDownload(url);print('✅ 下载完成,归还坑位');});}

✅ 优点:代码简洁,避免资源泄漏。适用于大多数场景,如 API 调用、文件读写等。

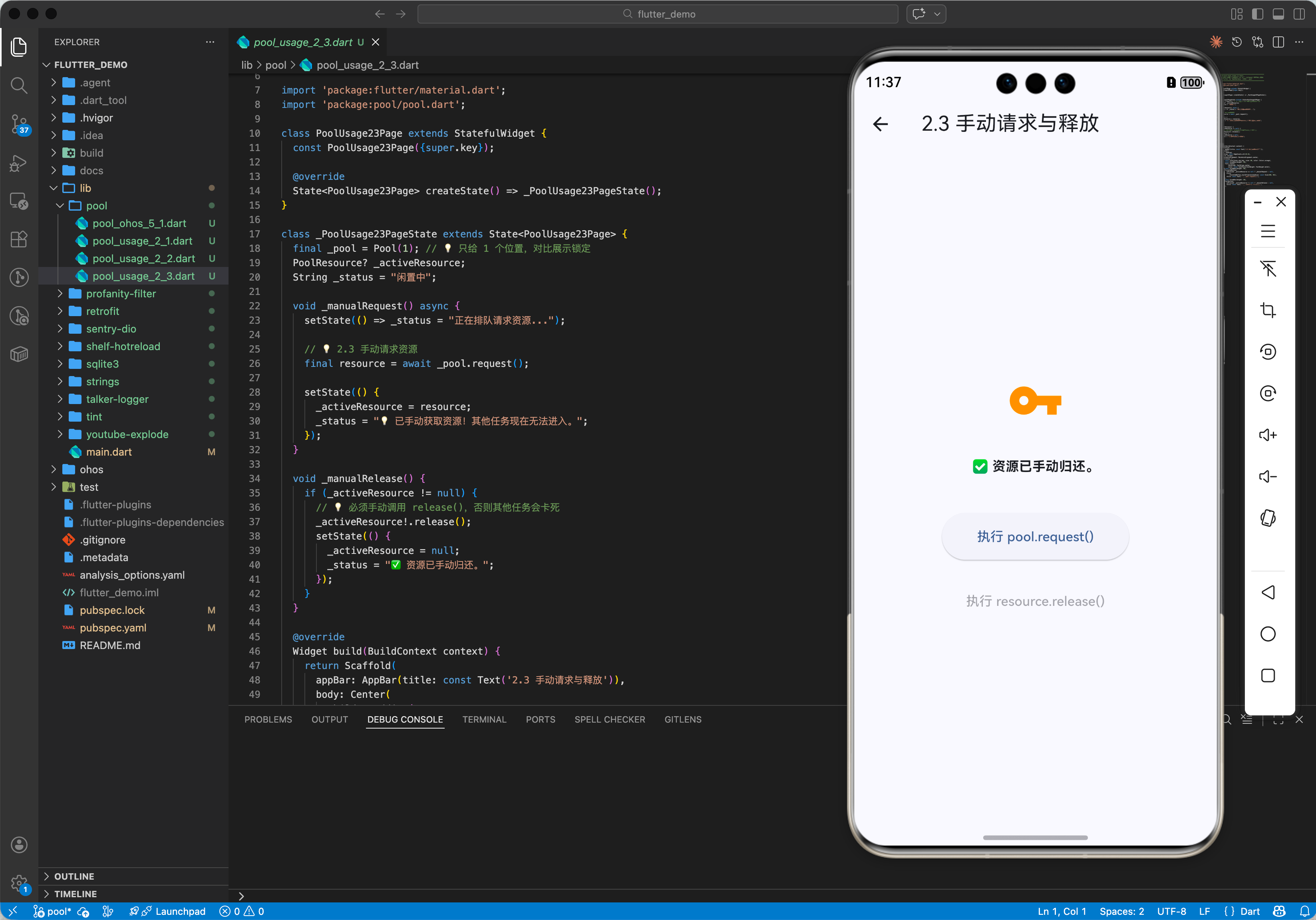

2.3 手动请求与释放资源

对于更细粒度的控制,你可以手动调用 request 和 release 方法。这在需要长时间占用资源或实现自定义中间件时非常有用:

final resource = await pool.request();

try {

// 处理业务...

} finally {

resource.release(); // 必须释放,否则其他任务会卡死

}

⚠️ 注意:手动模式要求开发者确保每个 request 都有对应的 release,否则会导致死锁。

三、常见应用场景:从相册到分布式网络

3.1 鸿蒙相册缩略图批量生成

当用户打开相册,需要为 100 张图片生成缩略图时,如果所有任务同时执行,CPU 会瞬间满载,导致 UI 卡顿。通过 Pool(3) 限制并发为 4,可以确保鸿蒙设备在生成缩略图的同时,保持界面流畅。

3.2 局域网设备大规模同步

在鸿蒙分布式网络中,向 20 个节点同步数据时,由于硬件限制,每次只能同时给 2 个节点发送包。利用 pool 可以轻松管理这一逻辑,避免网络拥堵。

四、OpenHarmony 平台适配:避开系统陷阱

4.1 避开鸿蒙系统的资源限制

技巧:鸿蒙系统的 HttpClient 虽然在底层处理了连接池,但在处理大量文件 IO 或自定义 Socket 连接时,仍需在 Dart 层手动介入。使用 pool 可以主动规避因并发过高引起的 TOO_MANY_OPEN_FILES 等系统级底层错误。

4.2 性能保护:削峰填谷

在鸿蒙低能耗设备上,过多的并发会导致调度频率变高,增加电池消耗。通过 pool 将任务“削峰填谷”,能有效降低能耗,延长续航。这类似于后端架构中的限流策略,确保系统在高负载下保持稳定。

[AFFILIATE_SLOT_1]

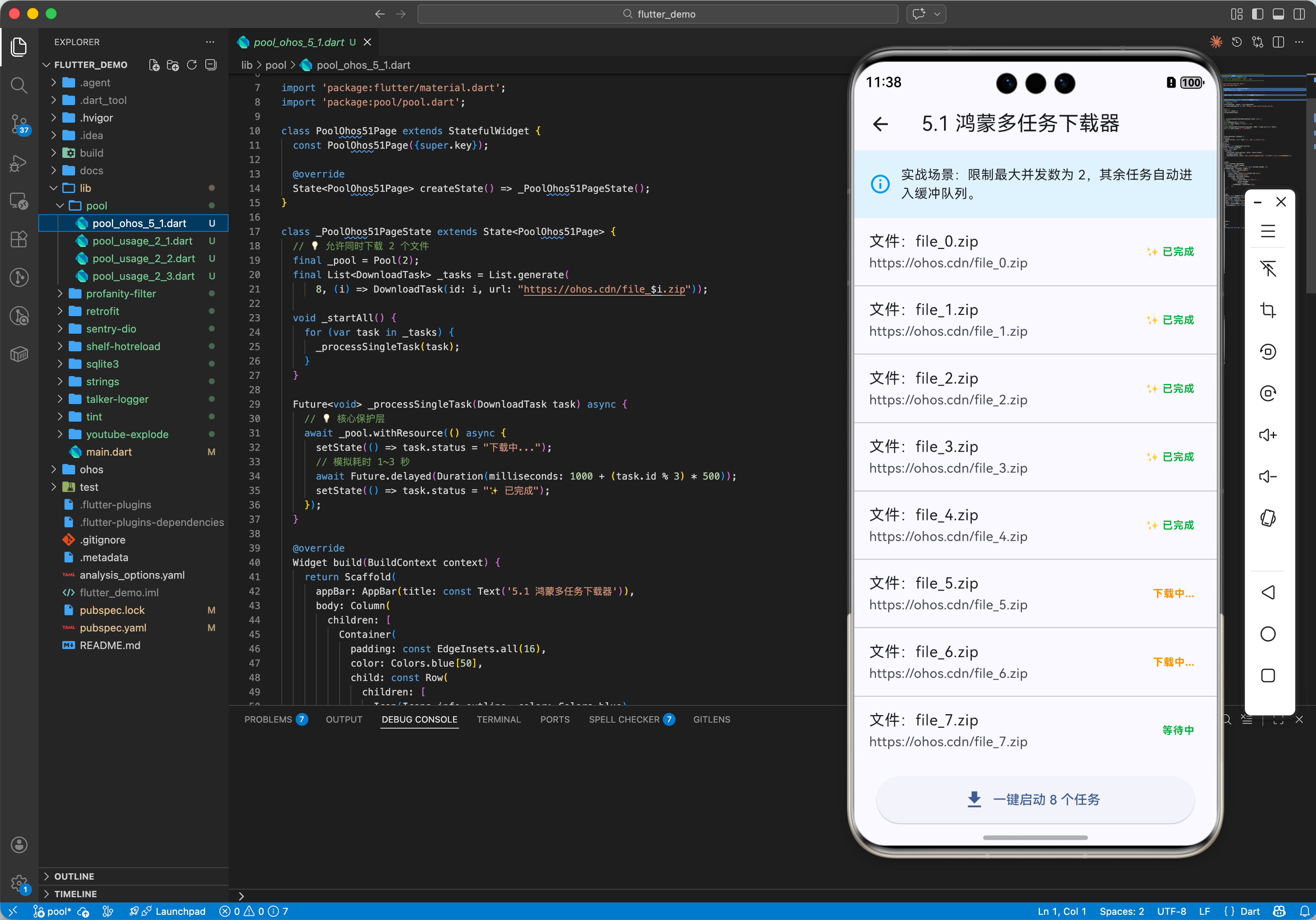

五、完整实战示例:鸿蒙多任务排队下载器

本示例模拟了一个包含 10 个下载任务,但限制最大并发为 2 的场景。代码展示了如何结合 pool 库与异步编程,实现一个可靠的下载管理器:

import 'package:pool/pool.dart';

class OhosDownloadManager {

// 允许同时下载 2 个文件

final _pool = Pool(2);

Future<void> runBatchDownloads() async {List<String> urls = List.generate(10, (i) => "https://ohos.cdn/file_$i.zip");print(' 准备通过鸿蒙下载中枢处理 ${urls.length} 个任务...');// 同时启动所有任务final futures = urls.map((url) => _processSingleTask(url));await Future.wait(futures);print('✨ 所有任务已队列化执行完毕');}Future<void> _processSingleTask(String url) async {// 核心保护层await _pool.withResource(() async {print('>>> [执行中] 处理 $url');// 模拟耗时 1 秒的异步操作await Future.delayed(Duration(seconds: 1));});}}void main() async {final manager = OhosDownloadManager();await manager.runBatchDownloads();}

实践建议:在实际项目中,可以将此模式扩展为数据库连接池或微服务调用限流器。例如,在 API 网关中,使用 pool 库限制对下游服务的并发请求数,防止雪崩效应。

六、总结:掌控并发,赢得稳定

pool 软件包是 OpenHarmony 开发者管理异步复杂性的“指挥棒”。它将杂乱无章的并发请求转变为井然有序的任务队列。在追求系统级稳定性和用户级丝滑体验的鸿蒙生态下,学会合理地控制并发密度(Concurrency Control),是构建健壮大型软件的必修课。无论是数据库连接池、API 限流,还是分布式同步,pool 库都能成为你后端架构中的得力助手。

[AFFILIATE_SLOT_2]

延伸思考:如果你正在构建微服务架构,可以考虑将 pool 库与消息队列(如 RabbitMQ)结合,实现更复杂的流量控制。此外,在鸿蒙的分布式能力下,pool 库还能与分布式数据库协同工作,打造真正弹性的后端系统。