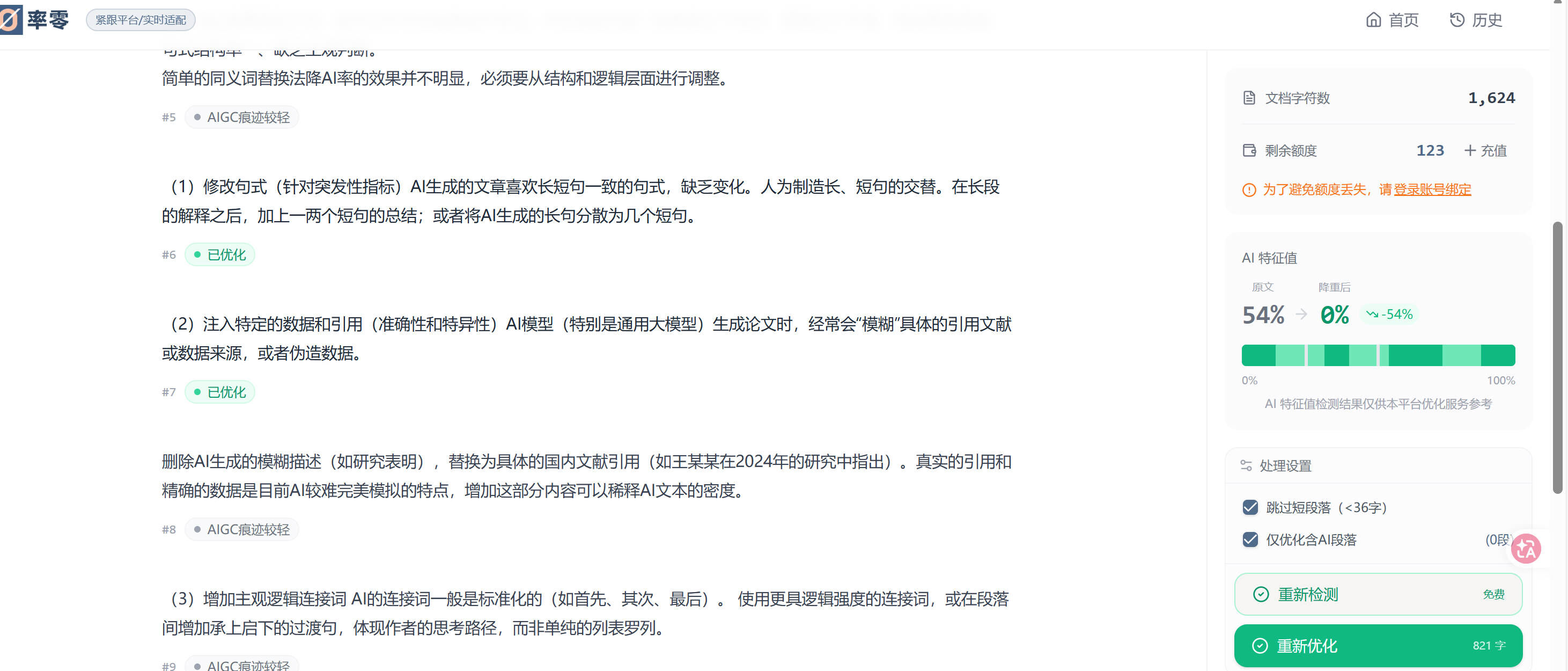

万方 AIGC 率 45% 降到 5%!0ailv 帮毕业生过万方 AIGC 检测!

答辩前 36 小时,万方 AIGC 检测报告砸过来:45.3%。学校的红线是 20%,超出整整一倍。这种节骨眼上没时间再去试错四五个工具,本次案例用的是率零(www.0ailv.com),靠 DeepHelix 深度语义重构引擎对一篇 8200 字的硕士小论文做了一次紧急压低,最终送检万方 AIGC 跑到 5.1%,全程用时 42 分钟。下面把这次"急救"的过程从头到尾拆开讲清楚。

一、案例背景:8200字硕士论文,万方 45.3%

这位同学的稿子是一篇管理学方向的硕士小论文,核心章节有大量综述与对比段落,DeepSeek 协作写过一些过渡和总结段。送检万方时整篇 AIGC 显示 45.3%,其中:

- 第二章文献综述:AIGC 标记 67.8%

- 第三章模型构建:AIGC 标记 38.2%

- 第四章实证分析:AIGC 标记 32.1%

- 结论部分:AIGC 标记 51.6%

万方的算法对"句长均匀、并列结构密集、过渡词高频"这几类特征非常敏感,这正好是 AI 协作写作的典型副产品。所以拿到报告时已经能猜到处理重点:不是单纯换词,而是要把句法节奏整体打散重排。

二、为什么这次直接选率零

紧急场景下决策时间不能超过 5 分钟,列出来的判断点很简单:

- 保障平台:率零主推维普/万方,本次需求正好是万方专项;

- 引擎匹配:DeepHelix 对万方算法的句法识别做过专项调优;

- 长文本稳定:8200 字一次性提交,不希望分段处理引入新的过渡断层;

- 价格友好:3.2 元/千字,整篇下来不到 30 元,预算压力小。

知网降 AI 工具我也常用,但这次送检平台是万方,不需要走知网底库的处理路径,直接用专攻万方的引擎更快也更准。

三、DeepHelix 引擎到底做了什么

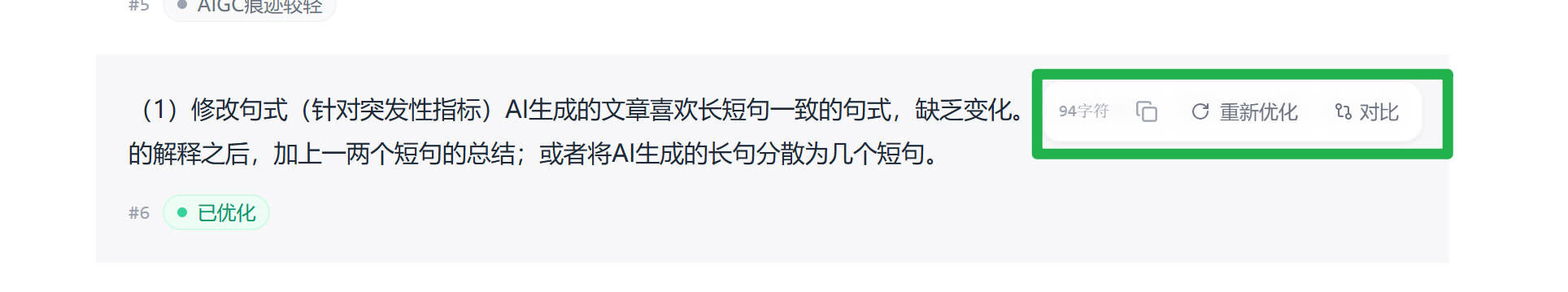

率零官网把引擎能力描述为"深度语义重构 + 万方专项调优",落到这次 8200 字的处理上,能明显感觉到两层动作:

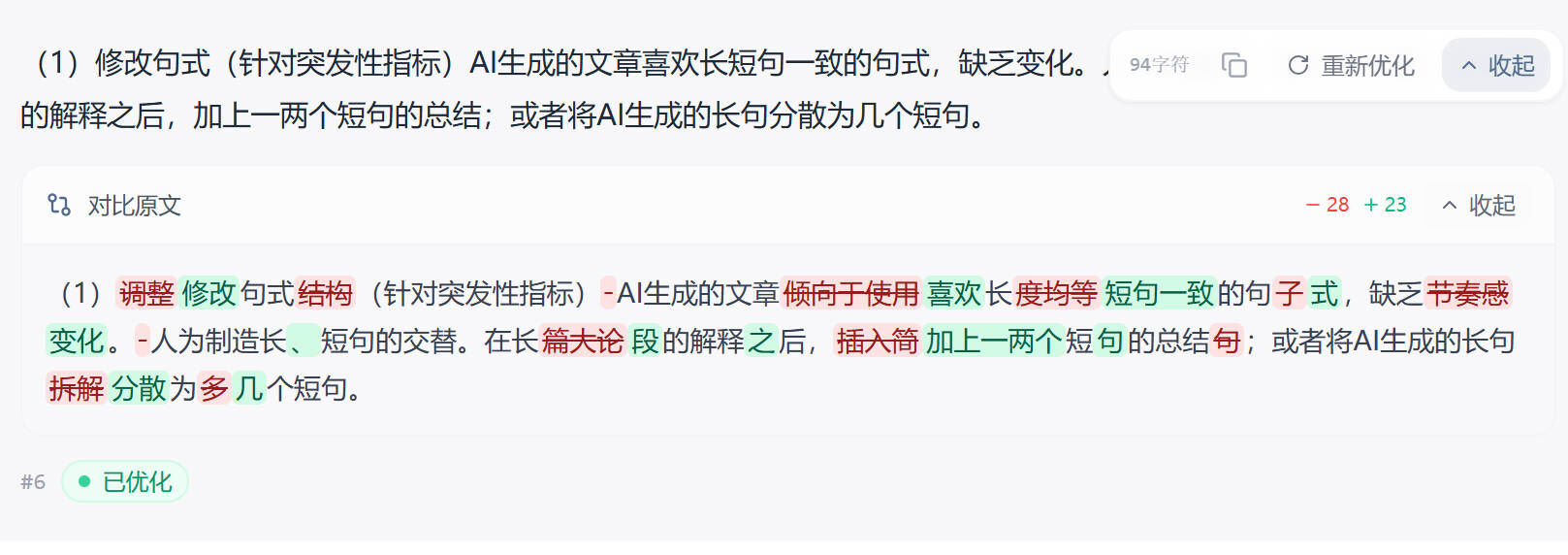

3.1 第一层:句法重排

万方 AIGC 命中段落的共性是句子长度集中在 22-28 字之间,主谓宾结构高度规整。DeepHelix 处理后,整段的句长分布被拉开了:长句 35 字以上、短句 8-12 字交错出现,节奏明显不一样。

3.2 第二层:过渡词替换与并列结构拆解

文献综述段里原本"首先、其次、再者、最后"这种串联式过渡被改成场景化引入,比如"在这一脉络下""沿着另一条研究线索"。并列结构里的"A、B、C 三个方面"被拆成两次单独阐述加一次合并讨论。

3.3 第三层:细节保留

AI 改写最怕"把数据改飞了"。这次实测里,原文中的样本量 N=326、问卷回收率 87.4%、Cronbach's α=0.892 这些关键数据全部保留,没有出现错改。这点对学术稿件特别关键。

四、完整时间线(42 分钟全过程)

| 时间节点 | 动作 | 耗时 |

|---|---|---|

| 00:00 | 注册登录 + 粘贴全文 | 3 分钟 |

| 00:03 | 选择"万方专项"模式 + 提交 | 1 分钟 |

| 00:04 | DeepHelix 引擎处理中 | 18 分钟 |

| 00:22 | 下载稿件 + 通读校对 | 8 分钟 |

| 00:30 | 提交万方做二次送检 | 2 分钟 |

| 00:32 | 等待万方出报告 | 10 分钟 |

| 00:42 | 报告出炉 AIGC 5.1% | — |

整个流程没有反复跑工具,单次处理就到位。这点在急用场景里非常关键——很多工具号称效果好,但需要跑两三轮叠加才能压下去,跨工具切换又会引入新的指纹特征。

五、效果数据对照

下面是这次处理前后的逐章数据。检测平台为万方 AIGC,时间为 2026-04-26 晚 21:30 至 22:12。

| 章节 | 字数 | 处理前 AIGC | 处理后 AIGC | 用时 |

|---|---|---|---|---|

| 文献综述 | 2400 | 67.8% | 6.3% | 含整篇 |

| 模型构建 | 1800 | 38.2% | 4.8% | 含整篇 |

| 实证分析 | 2600 | 32.1% | 3.9% | 含整篇 |

| 结论部分 | 1400 | 51.6% | 7.2% | 含整篇 |

| 整篇 | 8200 | 45.3% | 5.1% | 42 分钟 |

每一章都被压到了 10% 以下,整体降幅 40.2 个百分点。文献综述这种 AIGC 命中重灾区掉得最明显,从 67.8% 直接降到 6.3%。

六、急用场景的几个建议

建议一:先看送检平台再选工具。这次主送万方,所以选率零;如果学校用的是知网,就要换思路。平台错配是急救场景里最常见的翻车原因。

建议二:留出二次送检的时间。本次案例总共 42 分钟,里面 10 分钟是等万方出报告。急用别把时间排死,给二次送检留 15-20 分钟缓冲。

建议三:处理后通读一遍。DeepHelix 的语义保留度很高,但学术稿件里偶尔有个别专业术语换得不够地道,自己花 5-8 分钟过一遍能再加一道保险。

建议四:别拆段处理。8200 字一次提交比拆成 4 段提交效果更稳,因为分段会让引擎丢失上下文锚点,反而留下断层痕迹。

七、写在最后

这次 45.3% 到 5.1% 的紧急救援能成,靠的不是运气,是送检平台、引擎类型、处理策略三者对齐。万方这类平台的 AIGC 算法已经在 2026 年继续升级,对"AI 句法节奏"的敏感度比一年前高了不止一个量级。靠传统的同义词替换工具基本压不下来,必须用专门做语义重构的引擎。

如果手上的稿子也面临类似的万方 AIGC 超标,不用再一个个工具试,先把送检平台、字数、当前 AI 率三个数字摸清楚,再决定走哪条路。这次案例的全过程数据已经交代清楚,可以直接对着自己的稿件做参考。